"要有优化解就必须是凸函数,凸性被破坏情况下又会怎样,其实是多均衡的问题。英国皇家经济学会纪念经济学杂志一百周年的专刊中,有一篇文章专门讨论对现在正统的Von Neumann的预期效用函数的修改方案,讲到非凸性、非线性、非传递性的预期效用函数的种种可能方案"

用从水母体内分离出的生物荧光蛋白,照亮了神经元内部并拍摄了一段视频,揭示了蛋白质在神经细胞区室内运动的情景,可“看到”蛋白质定向地通过神经元以及大脑重建的过程。

网易探索8月26日报道 据物理学家组织网8月22日报道,最近,美国南加州大学一个研究小组利用从水母体内分离出的生物荧光蛋白,照亮了神经元内部并拍摄了一段视频,揭示了蛋白质在神经细胞区室内运动的情景,可“看到”蛋白质定向地通过神经元以及大脑重建的过程。相关论文最近发表在《细胞·报告》杂志上。

神经元内部区室分两种:轴突部分和树突部分。轴突是负责把电信号传给其他神经元的区域,而树突是从其他神经元接受信号的区域。论文领导作者、南加州大学博士生萨曼德·阿尔巴萨姆说:“十几年前人们就知道,蛋白质具有专门的定向性,只能进入其中一种区室。但不知道这种定向是怎么发生的,直到我们亲眼目睹了它们是怎么向其中一种区室移动的。”

上世纪九十年代中期,科学家从水母体内分离出绿色荧光蛋白(GFP)。GFP受到蓝光照射时,会发出亮绿色的荧光。用GFP做标记让人们能看到细胞和神经元内部的蛋白质。但因为神经元内有许多不同的、互相重叠连接的路径,至今还无法看到蛋白质在神经元内部的流动。

阿尔巴萨姆和同事开发出一种新技术,让人们进一步看清了蛋白质是怎样定向进入到两种区室之一的。他们通过阻塞单条路径,使浸满了GFP的运输泡产生堆积。运输泡是一种携带膜蛋白的小泡泡,能在神经细胞内上下移动。然后用一种小分子药物,使这些堆积的发光运输泡在一次强光脉冲下突然释放。论文通讯作者、南加州大学栋赛夫文理学院分子与计算生物学副教授多恩·阿诺德解释说:“结果令人非常吃惊。我们发现那些携带膜蛋白质的运输泡,应该进入树突的并不是一开始就瞄准了树突区室,而是两种区室都有进入。但那些进入轴突区室的很快就停下来,被阻止进一步深入。”

蛋白质是构成大脑的基本建筑材料。“人脑每天都在不断地分解、重建。从今天开始一周之后,构成大脑的蛋白质就会变得和今天完全不同。”阿诺德说,“这段视频显示了大脑的重建过程,以前我们只是知道这一过程,现在真实看到了这一

phymath999: qm01 一个量子系统的性质可由状态函数决定 ...

phymath999.blogspot.com/2014/08/qm01_18.html

轉為繁體網頁

轉為繁體網頁

物质波与波函数 - 360Doc个人图书馆

www.360doc.com/content/10/.../84590_34508202.shtml

轉為繁體網頁

轉為繁體網頁

神经网络_搁浅2012110429_新浪博客

blog.sina.com.cn/s/blog_12f76cc800102v4wo.html

轉為繁體網頁

轉為繁體網頁

神经网络简介

Deep Learning的本质是多层的神经网络,因此在深入学习Deep Learning之前,有必要了解一些神经网络的基本知识。 本文首先对神经网络的发展历史进行简要的介绍,然后给出神经元模型的形式化描述,接着是神经网络模型的定义、特性, 最后是一些最新的进展等。关于神经网络的分类、学习方法、应用场景等将在后续文章中介绍。

1945年,Von Neumann在成功的试制了存储程序式电子计算机后,他也对人脑的结构与存储式计算机进行的根本区别的比较,还提出了以简单神经元构成的自再生自动机网络结构。

1949年,心理学家D.O.Heb提出了突触联系强度可变的设想,并据此提出神经元的学习准则——Hebb规则,为神经网络的学习算法奠定了基础。

1958年,F.Rosenblatt提出了感知模型,该模型是由阈值神经元组成的,它试图模拟动物和人的感知和学习能力。

1962年Widrow提出了自适应线性元件,这是一种连续的取值的线性网络,主要用于自适应信号处理和自适应控制。

Minkey和Papert从数学上对感知机的功能及其局限性做了深入的分析,于1969年出版了《Perceptron(感知机)》一书, 提出感知机不可能实现复杂的逻辑函数,他们认为感知机的功能是有限的,不能解决如XOR这样的基本问题,而且多层的 网络还不能找到有效的计算方法,进而否定了这一模型。(其实在后来发现,加入隐藏层就可以解决XOR问题。)

虽然冯诺依曼结构和感知机结构大概是一个历史阶段的产物,由于《Perceptron》一书的悲观情绪和冯诺依曼机的快速发展, 神经网络进入了低潮。直到1982年Hopfield提出了HNN模型,他引入了“计算能量函数”的概念,给出了网络稳定性的判据, 推动了人工神经网络技术得以发展。特别是他提出的电子电路的实现为神经计算机的研究奠定的基础。

1986年,Rumelhart及LeCun等学者提出了多层感知器的反向传播算法,克服了当初阻碍感知机继续发展的重要障碍。 与此同时,冯诺依曼机在处理视觉、听觉、联想记忆都方面都体现出了局限性,促使人们开始寻找更加接近人脑的 计算模型,于是又产生了对神经网络研究的热潮。

目前,神经网络的发展非常迅速,从理论上对它的计算能力、对任意连续函数的逼近能力、学习理论以及动态网络的 稳定性分析上都取得了丰硕的成果。特别是在应用上已迅速扩展到许多重要领域,如模式识别与图像处理中的手写体 字符识别,语音识别,人脸识别,基因序列分析,控制及优化,;金融中的股票市场预测,借贷风险管理,信用卡欺骗检测等。

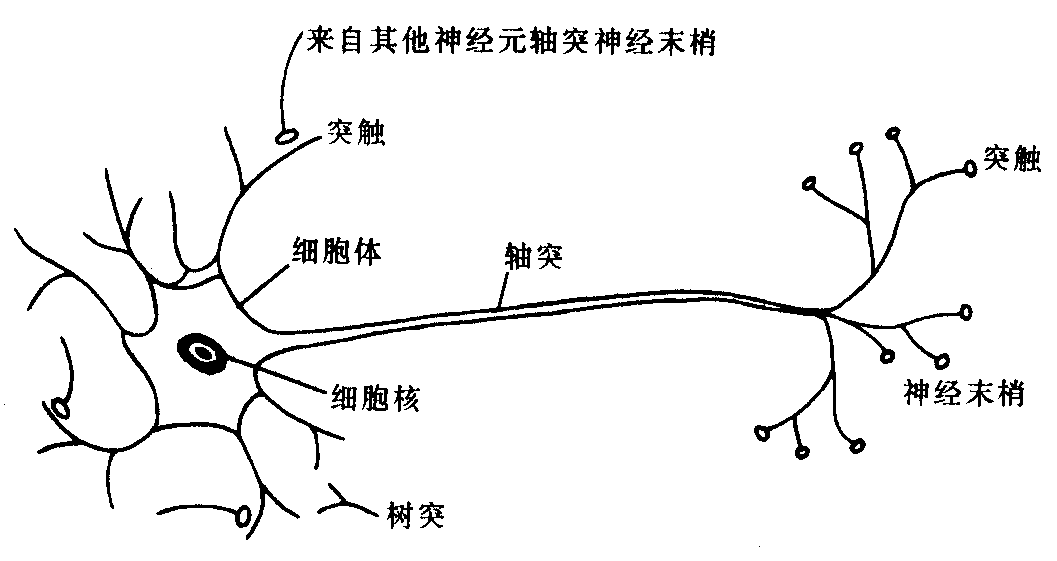

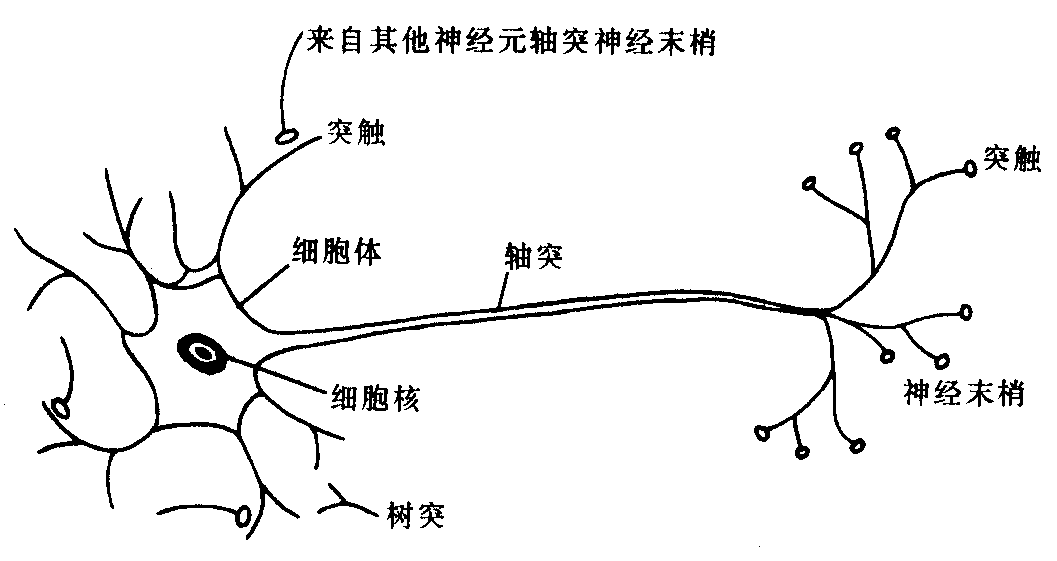

图1. 生物神经元结构图

更多关于神经元的生物学解剖,信息的处理与传递方式以及工作特点等内容请参见[4]。

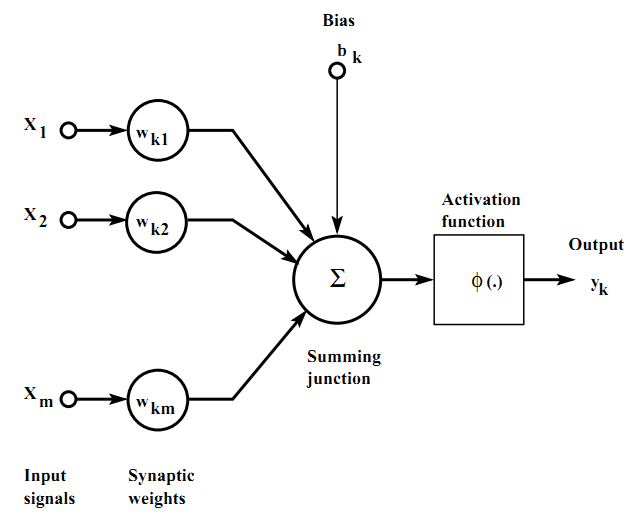

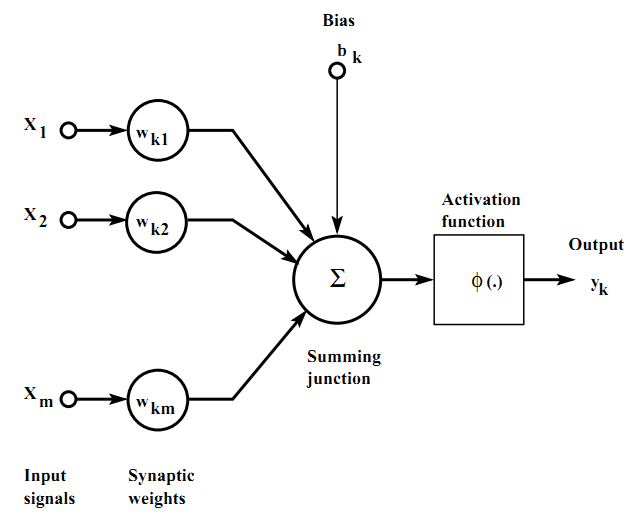

图2 神经元模型的形式化表示

u k =∑ m j=1 w kj x j

,

y k =φ(u k +b k )

.

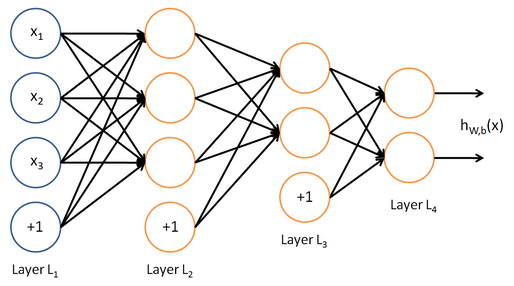

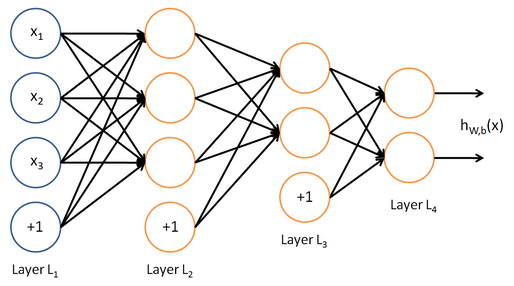

图3 一个典型的神经网络结构

人工神经网络(Artificial Neural Network,ANN)结构和工作机理基本上是以人脑的组织结构(大脑神经元网络)和活动规律为背景的, 它反映了人脑的某些基本特征,但并不是要对人脑部分的真实再现,可以说它是某种抽象、简化或模仿。

值得一提的是,谷歌的“Google Brain”项目,使用16000个PC机,从YouTube视频中找到的1000万张数字照片作为训练数据集, 用非监督学习的方法建立了一个拥有10亿多条连接的深层神经网络,最后成功的从中识别出猫咪的图片。

[2]T-61.3030 PRINCIPLES OF NEURAL COMPUTING (5 CP)

[3] Wiki - Neural network: http://en.wikipedia.org/wiki/Neural_network

[4] 百度百科-神经网络模型:http://baike.baidu.com/view/3406239.htm

[5] 人工神经网络综述:http://ishare.iask.sina.com.cn/f/36537774.html

[6] How bio-inspired deep learning keeps winning competitions:http://www.kurzweilai.net/how-bio-inspired-deep-learning-keeps-winning-competitions

[7] Google’s ‘brain simulator’: 16,000 computers to identify a cat:http://www.smh.com.au/technology/sci-tech/googles-brain-simulator-16000-computers-to-identify-a-cat-20120626-20zmd.html

1.发展简史

1943年,心理学家W.S.McCulloch和数理逻辑学家W.Pitts建立了神经网络和数学模型,称为MP模型。他们通过MP模型提出 了神经元的形式化数学描述和网络结构方法,证明了单个神经元能执行逻辑功能,从而开创了人工神经网络研究的时代。1945年,Von Neumann在成功的试制了存储程序式电子计算机后,他也对人脑的结构与存储式计算机进行的根本区别的比较,还提出了以简单神经元构成的自再生自动机网络结构。

1949年,心理学家D.O.Heb提出了突触联系强度可变的设想,并据此提出神经元的学习准则——Hebb规则,为神经网络的学习算法奠定了基础。

1958年,F.Rosenblatt提出了感知模型,该模型是由阈值神经元组成的,它试图模拟动物和人的感知和学习能力。

1962年Widrow提出了自适应线性元件,这是一种连续的取值的线性网络,主要用于自适应信号处理和自适应控制。

Minkey和Papert从数学上对感知机的功能及其局限性做了深入的分析,于1969年出版了《Perceptron(感知机)》一书, 提出感知机不可能实现复杂的逻辑函数,他们认为感知机的功能是有限的,不能解决如XOR这样的基本问题,而且多层的 网络还不能找到有效的计算方法,进而否定了这一模型。(其实在后来发现,加入隐藏层就可以解决XOR问题。)

虽然冯诺依曼结构和感知机结构大概是一个历史阶段的产物,由于《Perceptron》一书的悲观情绪和冯诺依曼机的快速发展, 神经网络进入了低潮。直到1982年Hopfield提出了HNN模型,他引入了“计算能量函数”的概念,给出了网络稳定性的判据, 推动了人工神经网络技术得以发展。特别是他提出的电子电路的实现为神经计算机的研究奠定的基础。

1986年,Rumelhart及LeCun等学者提出了多层感知器的反向传播算法,克服了当初阻碍感知机继续发展的重要障碍。 与此同时,冯诺依曼机在处理视觉、听觉、联想记忆都方面都体现出了局限性,促使人们开始寻找更加接近人脑的 计算模型,于是又产生了对神经网络研究的热潮。

目前,神经网络的发展非常迅速,从理论上对它的计算能力、对任意连续函数的逼近能力、学习理论以及动态网络的 稳定性分析上都取得了丰硕的成果。特别是在应用上已迅速扩展到许多重要领域,如模式识别与图像处理中的手写体 字符识别,语音识别,人脸识别,基因序列分析,控制及优化,;金融中的股票市场预测,借贷风险管理,信用卡欺骗检测等。

2 神经元模型

2.1概述

神经网络的基本组成单元是神经元,在数学上的神经元模型是和在生物学上的神经细胞对应的,也就是说,人工神经网络理论是 用神经元这种抽象的数学模型来描述客观世界的生物细胞的。因此,生物的神经细胞是神经网络理论诞生和形成的物质基础和源泉。 这样,神经元的数学描述就必须以生物神经细胞的客观行为特性为依据。本节在介绍了生物神经元的基本结构的基础上,给出了神经元 的数学模型和形式化表示。2.2生物神经元

生物神经元是大脑处理信息的基本单元,人脑大约由1011个神经元组成,神经元互相连接成神经网络。神经元以细胞体为主体, 由许多向周围延伸的不规则树枝状纤维构成的神经细胞,其形状很像一棵枯树的枝干。主要由细胞体、树突、轴突和突触(Synapse, 又称神经键)组成,如图1所示。

更多关于神经元的生物学解剖,信息的处理与传递方式以及工作特点等内容请参见[4]。

2.3人工神经元模型

神经元是神经网络中最基本的信息处理单元,其形式化表示如图2所示。

一个典型的神经元模型由以下3个部分组成:

1)突触集(a set ofsynapses):用权重(weights)来表示。

2)加法器(adder):将加权后的输入进行求和,即∑ n j=1 w kj x j

3)激活函数(activation function):也称为压缩函数(squashing function),作用于神经元的输出,一般是一个非线性函数,常见的有。 另外,很多时候一个神经元还包含一个偏置项bk。 可用用如下的数学表达式来刻画一个神经元:

1)突触集(a set ofsynapses):用权重(weights)来表示。

2)加法器(adder):将加权后的输入进行求和,即

3)激活函数(activation function):也称为压缩函数(squashing function),作用于神经元的输出,一般是一个非线性函数,常见的有。 另外,很多时候一个神经元还包含一个偏置项bk。 可用用如下的数学表达式来刻画一个神经元:

其中,u k

表示输入的线性加和,φ(⋅)

表示激活函数,y k

表示神经元的输出,x i

表示输入信号,w ki

表示权重。 很多时候,为了表示的简单,在输入中加入x 0

项、权重中加入w k0

项,将偏置b k

表示为x 0 ∗w k0

。

3. 神经网络模型及其特性

3.1概念

神经网络(Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的 许多基本特征,是一个高度复杂的非线性动力学习系统。一个典型的神经网络结构如图3所示。这是一个多层的(包含两个隐层L2、L3)、包含两个 输出单元的神经网络拓扑结构。

人工神经网络(Artificial Neural Network,ANN)结构和工作机理基本上是以人脑的组织结构(大脑神经元网络)和活动规律为背景的, 它反映了人脑的某些基本特征,但并不是要对人脑部分的真实再现,可以说它是某种抽象、简化或模仿。

3.2基本特性

神经网络具有四个基本特征:(1)非线性

非线性关系是自然界的普遍特性。大脑的智慧就是一种非线性现象。人工神经元处于激活或抑制二种不同的状态,这种行为在数学上表现 为一种非线性关系。具有阈值的神经元构成的网络具有更好的性能,可以提高容错性和存储容量。(2)非局限性

一个神经网络通常由多个神经元广泛连接而成。一个系统的整体行为不仅取决于单个神经元的特征,而且可能主要由单元之间的相互作用、 相互连接所决定。通过单元之间的大量连接模拟大脑的非局限性。联想记忆是非局限性的典型例子。(3)非常定性

人工神经网络具有自适应、自组织、自学习能力。神经网络不但处理的信息可以有各种变化,而且在处理信息的同时,非线性动力系统本身 也在不断变化。经常采用迭代过程描写动力系统的演化过程。(4)非凸性

一个系统的演化方向,在一定条件下将取决于某个特定的状态函数。例如能量函数,它的极值相应于系统比较稳定的状态。非凸性是指这种 函数有多个极值,故系统具有多个较稳定的平衡态,这将导致系统演化的多样性。4.近期进展

最近几年神经网络模型又成了研究热点,这是因为深层神经网络的学习方法取得了突破性的成就。2006年,以Hinton为首的研究人员在深度置信 网络(Deep Belief Networks,DBNs)方面的划时代性的工作,极大的减小了深层神经网络的训练和测试误差,从此深度学习的方法一路所向披靡, 在交通路标识别、字符识别、人脸识别、语音识别等方面的顶级Contest中都取得了最佳效果。值得一提的是,谷歌的“Google Brain”项目,使用16000个PC机,从YouTube视频中找到的1000万张数字照片作为训练数据集, 用非监督学习的方法建立了一个拥有10亿多条连接的深层神经网络,最后成功的从中识别出猫咪的图片。

参考文献

[1] Simon Haykin, “Neural Networks: a Comprehensive Foundation”, 2009 (3rd edition)[2]T-61.3030 PRINCIPLES OF NEURAL COMPUTING (5 CP)

[3] Wiki - Neural network: http://en.wikipedia.org/wiki/Neural_network

[4] 百度百科-神经网络模型:http://baike.baidu.com/view/3406239.htm

[5] 人工神经网络综述:http://ishare.iask.sina.com.cn/f/36537774.html

[6] How bio-inspired deep learning keeps winning competitions:http://www.kurzweilai.net/how-bio-inspired-deep-learning-keeps-winning-competitions

[7] Google’s ‘brain simulator’: 16,000 computers to identify a cat:http://www.smh.com.au/technology/sci-tech/googles-brain-simulator-16000-computers-to-identify-a-cat-20120626-20zmd.html

Original Link: http://ibillxia.github.io/blog/2013/03/20/basics-of-neural-networks/

Attribution - NON-Commercial - ShareAlike - Copyright © Bill Xia

Attribution - NON-Commercial - ShareAlike - Copyright © Bill Xia

大学数学实验 - 第 335 頁 - Google 圖書結果

https://books.google.com.hk/books?isbn=730210140X - 轉為繁體網頁

2005

... 每一个神经元又由内核、轴突和多个晶枝组成,晶枝形成一个非常精密的"毛刷" ... 函数/ ( z 十扔称为激活函数( aCtivat ; onfunction )或输出函数·这个实验的网络中, ...感知器- 維基百科,自由的百科全書 - Wikipedia

zh.wikipedia.org/zh-hk/感知器

[PPT]活化電位 - 計算式智慧暨人機互動實驗室

cilab.csie.ncu.edu.tw/course/nn/nn1.ppt

数据仓库与数据挖掘 - 第 91 頁 - Google 圖書結果

https://books.google.com.hk/books?isbn=7302106886 - 轉為繁體網頁

2005

神经元由细胞体、树突和轴突三部分组成,是一种根须状的蔓延物。 ... 元的输出; T ,为外面神经元与该神经元的连接强度(即权) ; 9 为阙值;广( r )为该神经元的作用函数。Sigmoid函数_百度文库

wenku.baidu.com/view/8ab1c12eb4daa58da0114a96.html

轉為繁體網頁

轉為繁體網頁

轴突_鲨派00024_新浪博客

blog.sina.com.cn/s/blog_b7223e260101edph.html

轉為繁體網頁

轉為繁體網頁

【长文】从控制论到复杂系统科学

来自: 岛人小山(地平线后面有我们想要的一切。) 2012-05-03 09:58:10

从控制论到复杂系统科学——陈平1996年3月在北京大学中国经济研究中心所作的讲演。收入:陈平著, 《文明分岔、经济混沌、和演化经济学》,总结,587-619页,经济科学出版社,北京2000年版。

【一.引论:科学重心的转移和科学规范的变革】

当代科学正在经历一个划时代的变革,包括科学研究重心的转移和科学思想规范的转变。因为我们正处于变革的过程之中而非变革的过程之末,所以目前使用的一些提法可能有争议。我们的目的是给科学变革的潮流钩画出一个大概的轮廓,使大家能及时把握创新的机遇。任何一个科学学派,总有其特色和局限;读者可以把这里介绍的一家之言和你所接触的其他学派相比较,从而寻找自己的道路。

我这次讲演的中心议题是,当代科学的发展--正从分析科学走向综合科学,世界的演化从趋同走向多样(Prigogine 1980)。认识理解世界的理论框架,也从以平衡或均衡观念为核心的古典静态(几何学)理论走向以非平衡观念为核心的现代演化(动力学)理论。这些变化发生在以计算机和遗传工程为主导的第四次工业革命、或称作第三次浪潮的时代(Tofler 1980),不是偶然的。

下面我们先从当代科学思想演变的基本线索谈起,然后再讨论科学革命的社会历史背景。当然,这两者实际上是相互关联的。

(1.1) 当代科学的三个前沿

科学研究有三个前沿,所谓的三个“极”:极小,极大和极为复杂。第一个“极”是“极小”。如分子、原子、基本粒子等。统治极小世界规律的是量子力学和量子场论。第二个“极”是“极大”。研究天体和宇宙空间。爱因斯坦的狭义相对论和广义相对论,奠定了研究极大的基础。在介于极大和极小之间的时空尺度上,牛顿力学主导经典运动的规律。

两次世界大战和随后的冷战,促使各国政府把主要的研究经费压在了极小和极大的研究上,制造原子弹、导弹、加速器、和空间飞船。二十世纪下半叶,理论物理上一个最重要的突破,就是杨振宁的规范场理论给极小和极大的统一场论开辟了道路。极小和极大的研究,从基础到应用的周期很长,所以,其基础研究经费主要靠国家的军费支持。尽管对科学家来说,极小和极大的研究具有永恒的魅力,冷战之后军费的大幅削减,使这两方面的研究规模近年来大为缩小。科学研究的重心,正向生物学和经济学转移。这就引向科学的第三个前沿。

这第三个是最古老、最困难、在本世纪投入也最少的领域。它处在极大和极小之间,和我们人类特定的空间和时间尺度处在同一个量级上,这个领域可称为“极为复杂”。生命和社会系统的研究,比物理化学系统困难得多。经济学家面临的挑战,远比物理学家严峻,因为经济系统正是最难处理的一类复杂系统。在研究极大、极小这二个领域上发展起来的古典物理学,在解释生命和社会现象时,就碰到了非常基本的障碍。我们可以说:科学史上下一个最大的挑战、或最大的希望,就是这个“极为复杂”的领域。

(1.2) 科学从分析到综合的发展

西方科学的主流是从希腊原子论到现代基本粒子论为代表的分析科学。我们今天讲的新兴的复杂系统科学(science of complexity), 或称复杂系统(complex systems),七十年代还有一个名称,叫自组织理论(self-organization theory)。她是与西方传统从希腊原子论到现代基本粒子论为代表的分析科学相对立又互补的研究路线。

主导极小和极大的物理理论,都源于希腊的原子论和几何学。原子论的基本思想是复杂事物可以分解为简单组元之和。假如简单组元的运动规律相对简单,而组元之间的相互作用可以忽略,使它们的整体运动可以简单相加,则复杂事物的运动规律,可以还原为较低层次组元的运动规律。所谓一加一等于二,是线性求和的简单例子。这在数学上,可以方便地用几何图象来描写。牛顿动力学和爱因斯坦相对论的宇宙观,都基于本质是静态的几何学。但是,你假如对活的生物进行分解,就可能改变生物活动的正常状态以致死亡。原因是生物体组元之间的相互作用和相互耦合,比机械运动强得多。所谓一加一大于二,是复杂系统的典型特征。古希腊原子论的分析方法和中国老庄哲学的整体论思想是不同的。近代分析科学成长的一个重要原因是,数学定量描写,首先用于机械运动这样的简单系统。生物学中达尔文的进化论和经济学中马克思的社会演化理论,都没有适宜的数学理论作支持。描写复杂系统的数学工具在本世纪七十年代才获得突破。

“极为复杂”的研究,尤其是对生命和社会现象的研究,基本问题究竟是什么?它有二个令人深思的问题,或者说是一个问题的二个方面(Prigogine 1980):

【第一个问题】是,为什么生物和社会这样的复杂系统能够存在(being)?

【第二个问题】是,这些复杂系统为什么能够演化(becoming)?

从科学思想史的角度看,演化问题是最古老的科学问题。中国的老庄哲学很早就有演化论的思想。老子说,天下万物生于有,有生于无;又说一生二、二生三、三生万物。假如你知道混沌现象产生的条件是自由度大于三,而目前经济学均衡理论的局限,在于优化理论只能处理二体问题,你就会惊叹中国古代哲人的大智慧。

在讨论复杂系统科学之前,我们有必要澄清和复杂科学研究有关的一些误解和提法。所谓科学,严格来讲是指“经验科学”。我不想使用哲学上有争议的“实证科学”的说法。经验科学从方法论而言,意味着可以对研究对象进行观察,并进而作定量的描述;根据观察建立的模型或假说,可以被实验定量地观察和检验。科学研究的方法是从简单到复杂,逐步发展起来的。当代经济学从定性的政治经济学,到定量的数理经济学的发展史,也是数学、物理学、工程学和生物学对经济学思想方法的交叉渗透史。所以我们要在数理经济学上有所创新,一定要关注相邻科学的发展。

中国以前对跨学科的研究,有个源于传统但近乎嘲讽的说法,叫作“杂家”。当然,兴趣广泛的杂家,可能在科学哲学、或者自然辩证法的研究上,对复杂科学的思想作出有益的介绍和评论,但这不是我们今天讨论的内容。我们强调的是严格意义上的复杂科学研究,强调的是科学研究方法上的突破,而非哲学意义上的结论。这点务必请大家注意。

从科学方法上,国内有所谓老三论、新三论的说法,把几个层次完全不同的理论联在一起。老三论包括:控制论、信息论、和系统论。新三论包括:突变论、协同学、和耗散结构论。这种提法,就科学普及而言,也许有助于记忆,但在理论发展的思路上,可能有所误导。从科学方法看,老三论大体上属于线性理论的范畴,基本框架是古典物理的经典力学和平衡态热力学。新三论属于非线性理论的范畴,共同的数学工具是分叉论(bifurcation theory)。

在老三论中,系统论在哲学上发展了和分析科学对立的整体论思想;但在数学方法上,系统论实质上是应用控制论,没有新的突破。在新三论中,突变论是一个有争议的数学理论而非物理模型;协同学只有简化复杂系统研究方法上的设想,在生物和经济研究上,至今未有实质性的突破。系统科学中真正有开拓性贡献的当属控制论、信息论、和耗散结构论。八十年代开始,科学界对这些以非线性数学为基础,以现实问题,从物理、化学、生物、到经济、生活,系统进行研究的新兴交叉领域有个总的称呼,叫做复杂系统科学、或自组织科学,以区别于四、五十年代发展起来的以线性数学理论为基础的系统论。

(1.3) 科学研究方法和科学革命

从我个人的经验出发,我对同学们有个建议,在科学研究中,不要轻易接受已有的理论。马克思最喜欢的两句格言是:“关于人类的事物我都要知道”,和“对于万物都要问个为什么?(这是我的译法,传统的译法是:对于万物都怀疑)”。因为怀疑本身未必有建设性的成果。世俗的怀疑常常是疑而不决、疑而不为,以致存疑终身。

科学的怀疑是问为什么,是分析比较现有的互相竞争的理论,从观察中和论战中,寻找你进一步研究的出发点。这就要去猜测现象背后的机制,用可以观察到的经验事实,来检验你早先的猜测,是对是错。即疑而观察,疑而待决。

对前人的科学成就,怎样去继承和发展?我以为,一要懂得欣赏,知道其成就的关键在何处;二要尝试发展,因为任何高峰本身就是其局限。不懂得欣赏的人,也可以批评,但因不解其妙,批评往往难中要害。我们常常听到西方主流理论的捍卫者答辩说,旧理论的缺点虽多,但并无更好的新理论取而代之。这正是对批评者最大的挑战。真正有潜力的科学理论应当象爱因斯坦的相对论那样,把牛顿力学作为近似包括在新体系之内,而不是简单地否定已有实验基础的旧理论。

下面我们简单地介绍复杂系统研究的基本问题和基本思路。

【二.均衡论、控制论、和系统稳定性的机制】

从四十年代开始,对生物和社会现象感兴趣的科学家,主要关心的是【第一个问题】,就是复杂系统为什么会存在?

(2.1) 均衡论、优化论、和势函数

经济学家在经济系统的描述中,引进了稳态或均衡的概念。“稳定”和“均衡”这两个概念是从古典力学和古典热力学中借鉴过来的(Mirowski 1989)。古典力学一个重要的发展是保守系统中,哈密顿力学的优化形式。它对量子力学与经济学的形式体系,有重大影响。对一个无摩擦力的保守系统,牛顿力学的动力学方程,可以从变分原理导出。其中最重要的一个优化目标函数,就是能量。系统处于稳态时的自由能最小。匈牙利数学物理学家冯·诺依曼(von Neumann〕在建立博弈论时,把预期效用函数(expected utility function)引进了经济学(von Neumann and Morgenstern 1944)。经济学中效用函数和生产函数的概念和古典保守系统中的势函数大致相当。哈密顿力学假设在一个没有摩擦力的保守系统中,势函数存在,力学中动力学的轨道问题可以转化为数学上的优化问题。

均衡经济学假设在一个没有摩擦力,也就是没有交易成本和税收等经济摩擦的均衡经济中,效用函数和生产函数的概念,可以引入经济系统,把经济稳定性与理性预期下的优化行为结合了起来。所谓最优化,意味着在很多可能性里面选出一个特殊的解。如果这个选择是唯一的,就有理由猜测均衡态应当是稳定的。微观经济学的生产和消费理论,金融理论中的有效市场假说和股价变动模型都是均衡理论的典型代表。

(2.2) 控制论和负反馈机制

对一般的控制系统而言,什么样的动力学机制,能导致稳定性呢?经典控制论的回答是负反馈机制。控制论的创始人是美国数学家维纳。他对控制问题的研究,从防空武器对飞机的追踪过程开始,进而受到神经生理学家对运动不协调病人观察的启发(Wiener 1948)。维纳从信息处理的角度,给了稳定性起源一个非常简单的答案:稳定性的机制在于负反馈。

举例来说,我们设定一个空调系统的室温为25℃。高于25℃给一个信号,让其下降,低于25℃,给出一个信号让其升温。负反馈的控制信号与原信号增量的符号相反。控制论的负反馈机制是均衡经济学的基本思想。经济控制论是工程师们把工程控制论,移植到经济学中产生出来的来的。不少著名的经济控制论专家是学电机工程出身的。

和控制论平行发展的是美国工程师申农建立的信息论 (Shannon 1948, Shannon and Weaver 1963)。信息熵是对信息定量的测量,它借用了平衡态热力学中熵的概念。熵是一个无序的量度。信息熵实质上是一个无知的量度。信息量的多少,取决于可能的状态数目。比如猜一个答案,如只有一种可能,你的猜测,事实上没有增加任何信息,信息熵为零。如果有二个可能的状态,你知道各自的概率不一样,信息就多一点。可以用这个方法来求对各种可能性加权的平均猜测。但是信息熵所测量的并不是我们的知识,而是我们的无知。比如说投资者在不知道结果是赔是赚的前提下,我们就假设输赢可能发生的概率相等,这恰是最无知的情形,而此时信息熵最大。目前我们还缺乏如何描写有层级结构的知识,这对下一代的信息论将是一个挑战。

应当指出,古典力学和古典统计力学的方法在控制论和信息论的发展过程中,起了重要作用。对任何动力学系统,我们可以用决定论的数学方法,也可以用概率论的数学方法去描写。原则上说,假如我们知道所有的独立变量,以及它们所有的高阶导数、或系统偏离其平均值的高阶矩,这个系统在数学上可以唯一确定。这在实际上不可行。

科学研究方法的核心问题是如何简化系统的数学描写,数学上说就是如何降低刻划对象的维数而不失去经验规律的主要特征。牛顿力学发现,对满足经典力学要求的机械系统,二阶导数就够了。相应地,对能量守恒的保守系统,二阶矩的统计描写也足够了,亦即服从高斯分布的正态系统。物理学的这些近似得到了不少实验验证。但是经济学的近似几乎没有实验的基础,基本原因是经济系统不是保守系统。

计量经济学中一个基本假设是说所有经济学的变量都服从高斯分布,又称正则分布。系统的统计性质可以由一阶矩的平均值和二阶矩的方差唯一确定。穆特的理性预期假说就明确地提出,理性优化行为指导下的线性动力学行为由高斯分布刻画(Muth 1961)。在平衡态的条件下,一个用概率分布函数描写的动力学系统,其平均值可以由一个决定论的方程描写。经济学中一个常用的概念叫确定性等价(certainty equivalent),把涨落不定的统计量,例如回报率和利润率,用确定的平均数来作简化的描述。马克思讲价格围绕价值波动。金融理论讲股票价格的内在价值,前提也是平均值存在和有意义。我们将会看到,平均值的概念在非平衡态下,可能失去意义。价值在技术变革或社会变迁时期,是难以测量和估计的。

(2.3) 均衡经济学和扩散过程

平衡或均衡理论对经济现象的成功解释,可以归结于扩散和趋同这一类现象。比如在充分竞争下,价格变动应该是收敛的,差别应该越来越小,这本质上是一个扩散现象。新的技术发明,新的思想总是向外扩散。在孤立系统中,温度应该趋同,差别最终消失,这就是古典热力学第二定律的结论。如果这个理论是普遍真理,那么宇宙将要热寂,温差总要消失。一切结构最终都会瓦解,人都要死的。它意味着宇宙演化的终极是一个均匀化的无差别系统。

均衡经济学的核心问题是证明均衡解的存在性,唯一性和稳定性。最有名的例子是新古典微观经济学的阿罗一德布罗(Arrow-Debreu)模型。这是一个线性、无摩擦的理想经济系统。阿罗在数理经济学上一个漂亮的工作,是用拓扑学的不动点定理,来证明市场经济有内在的稳定性。宏观经济学中最有代表性的经济波动模型,出自第一个得诺贝尔经济学奖的挪威数学家,计量经济学的创始人弗里希。他用古典力学中的阻尼谐振子模型(damped oscillator) 来描写稳定的市场经济(Frisch 1933)。他假设任何外来的经济冲击都会导致衰减振荡,因为有摩擦力存在,经济波动的振幅会是越来越小。若如此,又怎样理解持续的经济波动呢?均衡经济学的解释是求之于外因:经济波动必须由外来的噪声驱动和维持。在计量经济学中占统治地位的霍维尔莫模型,把整个经济描写为噪声趋动的线性系统(Havelmoo 1944)。

计量经济学的噪声驱动理论对生物学家来说,是很奇怪的事情。大家知道,人的正常心脏跳动频率在每分钟六十跳到八十跳左右。如果说心脏跳动是环境里的噪声在那里驱动,生物还能维持心脏跳动的频率稳定吗?显然不可思议。(提出问题来思考)古典经济学的创始人马歇尔在他的名作“经济学原理”的序言中说过,经济学应当接近生物学而不是力学(Marshall 1920)。只因生物学难于用数学描写,才借用力学的比方,但经济学家头脑里应当有生物学的观念。

相信均衡理论的经济学家干脆不接受经济波动的事实。均衡经济学家以为,经济系统的理想状态应该是均衡的,没有波动的,没有结构的。看来,新古典经济学家的数学知识增加了,但经济学的直觉反而退步了。

[我在这里说点题外话。科学史上一个有趣的教训,理论僵化的往往不是祖师爷,而是教条化的后代弟子。牛顿不是牛顿主义者,马克思也说过他不是马克思主义者。读者学习科学,不要光想走捷径,只读二、三流弟子写的简化通俗的教科书,要尽可能多读大师的原作,才能学会研究的方法。]

均衡经济学七十年代达到顶峰,八十年代受到了挑战。下面我们会看到,新的社会实验,即三十年代西方经济的大萧条和八七年发生的股市崩溃等事件,动摇了人们对均衡经济理论的信心。注:(结果动摇原有的理论和信心,结果也可以归纳出理论和树立信心。)

【三.系统复杂性的初步探讨:从观察到猜想】

物理学家首先从生命现象的观察出发,对古典热力学的平衡态理论提出质疑。量子生物学对生命现象的物理机制提出卓有远见的猜想。突变论、协同论对复杂系统的行为描述进行了初步的探索。不同学科的发展为复杂系统研究的突破开辟了道路。

(3.1) 多样性问题的提出

对注意观察实际生活的理论家来说,有一系列的新问题可以促使他们超越均衡观的局限,注意到世界多样性的起源。第一个问题是生命的起源。如果世界是稳定和均衡的话,生命就不可能产生和演化。请注意:生命演化的前提还不是达尔文的物种演化,而是生命发生前化学结构,从无到有的演化。达尔文理论的前提是必须先有遗传性能的大分子,才能有后面的物种演化。最开始宇宙是一个均匀的气体或称为“原始汤”的液态,它怎么会演化产生出非均匀的分子结构,并从低分子演变到高分子结构呢?

第二个问题是关于宇宙的起源。现在最时髦的宇宙学是宇宙大爆炸理论,那么爆炸以前呢?除了真空什么也没有。这也是一个非常有争议的理论。

科学史上一些理论的荒谬是从某个成功的理论中无限外推而产生的。任何理论的有效都有一个界限,找到这个极限就可以做一重大的改良。爱因斯坦的广义相对论在解释行星、恒星运动时非常成功。爱因斯坦的基本想法就是把一个生命的、动态的、多样化的世界简化成一个静态、几何化的世界。经济学中的均衡观也是一个类似的几何观念,例如微观经济学中的描写帕累托最优(Pareto Optimium)的艾奇沃思盒(Edgeworth Box),就是均衡经济的静态几何观的典型表现。但是,几何化的办法在解释生命社会现象丙不成功。

第三个不能回答的是李约瑟问题,涉及到经济学的范围,即近代科学和工业的起源,资本主义的起源,为什么会在西欧而不是中国,不是阿拉伯或印度?

第四个问题是市场经济持续波动的原因。这一问题在经济理论上的严重性是在70年代以后才被人们认识的。三十年代大萧条促使凯恩斯挑战古典经济学的信念,所谓看不见的手会自动达到市场稳定与充分就业,这个信念已经动摇。但凯恩斯的信徒们发展了经济控制论,把工程控制搬到经济学中。在60年代美国经济鼎盛期,他们一度认为美国的经济波动已经消灭,经济周期(business cycles)这个概念已过时。他们信心十足地认为政府可以对宏观经济进行“微调”,好象政府有经济控制的旋钮一样。但很快石油冲击和越战发生,通胀来了,黄金与美元被迫脱钩,这些都使经济学家重新认识到经济波动的持续存在。

中国的文化大革命中,毛泽东关于中国运动七、八年就来一次的说法,也使社会主义经济学家认识到计划经济也无法避免经济波动。所以70年代是一个很大的转折点。光给市场经济唱赞歌,信仰市场经济的稳定性到七十年代已经不够了。人们要问为什么经济发展会有波动和不稳定。不稳定性的来源一定和控制论研究的主题——负反馈机制--相反的问题有关。

历史上有远见的学者,可能会把问题提出得非常早,但能否受到社会的普遍关注还有待历史的进程。正如库恩在“科学革命的结构”中所言,科学规范的演变不光是科学家内部逻辑演变的结果,而且和社会思潮变迁的推动有很大关系(Kuhn 1962)。

假如你相信新事物的产生满足大数定律,资本主义产生的必然性是普遍有效的话,那么科学革命应该发生过很多次,而生命的产生也有很多次了。尽管不少技术的发明有重复性现象,然而,很多事实表明,生命与科学的产生是一种非常偶然的现象。

以上几个问题都涉及怎么解释从无序到有序,从比较简单的到比较复杂的东西。古典科学的理论,包括优化理论、线性稳定性理论不能回答这些问题。

(3.2) 薛定锷和量子生物学

在复杂系统研究中,一个重要的先驱者是奥地利物理学家薛定锷,他是量子力学的创始人之一。在其“生命是什么”的著名讲演中,他认为古典力学和平衡态热力学的理论是难以理解生命起源的。他尝试用量子现象来研究生命(Schrodinger 1944)。他提出了三个非常重要的猜想,所有这三个猜想都对后来的科学发展起到了非常重要的贡献,虽然当时这些猜想只是定性的,没有给出任何定量的方程。

他的第一个猜想是,演化的基础必须是亚稳态。假如在平面上放一个球,那是不稳定的,就好比游牧民族;如果把球放进一个无穷高的位垒,它一定是非常稳定的,状态很难变化。

中国的封建社会这么长,就是位势太高了。如果你既要解释这个系统的稳定性又要解释这个系统的可变性,描写的办法是在这二者之间找一个中间态,它的位垒是有限高的。这样,对一个多稳态的系统,外面有一个干扰,例如宇宙线的打击,或者其他文明的冲击,就会使粒子状态发生跃迁,从能量较低的亚稳态跃迁到能量较高的亚稳态。

他的第二个猜想是,生命秩序的结构形态,应当是非周期性的晶体。如果是晶体点阵就太规则了,静态的结构很难变化;象气体那样完全没有规则也不行。如果要有生命,只能是在晶体和气体之间的中间结构,他称作非均匀、非周期性的晶体。薛定锷的学生们在生物实验中研究了蛋白质大分子的结构,终于发现遗传密码,其研究思想来自于薛定锷。

薛定锷的第三个猜想是,结构演化的度量应当是负熵。如果信息熵测量的不是秩序,而是无序的程度,那么秩序的测量就应该倒过来,是负熵。如果生命的演化是从无序到有序,从低级到高级,那么就标志着负熵的增加,所以负熵是秩序,熵是无序。

(3.3) 突变论的提出和争议

前面所说的是一些理想实验或定性猜测,没有发展成系统的数学方法。1963年代法国数学家汤姆(Thom)提出了突变论(catastrophe theory),开始时轰动了很多领域。突变论研究的是保守系统,理论上可以有一个势函数。不同模型的变量数不同,可能发生突变的类型也就不同。可以从拓朴学上对突变类型加以分类。最熟知的突变例子就是物理学中的相变。突变论迅速被用于许多先前被认为无法用数学描述的现象:例如一只狗为什么会突然咬人或逃走,囚犯为什么会突然暴动或退缩,股票为什么会突然暴涨或暴跌等等,都有人设想出某种势函数来加以描写(Zeeman 1977)。但这股风潮受到前苏联著名数学家阿诺尔德(Arnold)的严厉批评。阿诺尔德指责汤姆没有发现任何新的问题,只是将已知的例子(例如相变)贴上了数学名词的新标鉴,而诸如心理学、股市运动之类新的势函数的存在,理论上根本无从说明。从经验科学的标准而言,突变论是一个失败而非成功的例子。

(3.4) 集合行为和协同学

第三个理论在物理学界很有影响,但在生命科学和社会科学中没有多少应用,这就是德国物理学家哈肯提出的(Haken 1977)的协同学(Synergetics)。

复杂系统从数学而言是多体问题,从物理学角度来说研究的是集合行为。这么多变量数学上怎么处理?经济学界有一个著名的奥地利学派,他们根本就不相信一个社会经济系统可以用数学来描写。他们认为经济系统太复杂了。描写一个人应该有多少变量?人的自由意志也许该有无穷多个变量。这样一来,社会研究便只能讲历史故事,没什么科学模型可做了。

复杂系统研究的主要问题是怎样把一个无穷多变量的系统简化成一个相对简单的低维数系统,从而有助于定量研究复杂系统的规律。协同学的核心是所谓奴役原理(slave principle)。哈肯提议把变量分类:一部分是慢变量,一部分是快变量,在相对短的时间尺度内假设慢变量不起变化,可以视为常数,这就大大简化了系统的描述。这一方法在物理学中有广泛的应用,通常称作“绝热近似法”。但对经济学来说奴役原理很难应用,因为经济学中很多变量的变化率是同一个量级的。物理学可以通过可控制实验来减少变量数,但社会问题很难做可控制的实验。哈肯本人想到的经济中的慢变量是语言和文化,这在经济学模型中很少给以考虑(Haken 1998)。所以协同学在经济学中影响很小。

【四.复杂系统科学的兴起:非线性、非平衡、和非稳态过程的研究】

现在我们来讨论复杂科学在近二十年间的巨大突破。决定论混沌(deterministic chaos或简称为chaos)理论、和非平衡统计物理的发展,为自组织系统的理论奠定了坚实的基础。非线性、非平衡、和非稳态过程的研究为复杂系统行为的定性与定量研究打开了广阔的天地。混沌理论的数学基础是非线性动力学。开始阶段只是一些计算数学的模拟试验,并不和实验观察相联。复杂系统真正有意义的突破不但从大量经验观察中发现混沌现象的普遍存在,而且发现非线性机制的若干普遍特点,使人们大大加深对现实世界的了解。

(4.1) 庞加勒(Poincare)和不可积问题

如果你单单讨论稳定性的话,事实上是在将复杂现象简单化为古典力学和平衡态热力学中已经了解的简单现象。你研究的对象虽是复杂系统,你思维的方法仍停止在简单系统。所以深入研究复杂性,是从稳定性问题的反面开始--探讨系统不稳定性的机制。

概括地说,建造经典力学的大厦只有二种漂亮的砖块。一块是伽理略开始研究的钟摆,数学上称作简谐振荡(harmonic oscillator);另一块是爱因斯坦研究过的布朗运动(Brownian motion),数学上又称随机游走模型(random walk model),工程上叫做白噪声 (white noise)。古典物理学家认为这二个砖块已经足够漂亮了,只要把砖块象积木一般搭起来,就可以构成漂亮的大厦。任何一个复杂系统,可以用简单的线性系统作足够好的近似。

这个信条很快被打破了。混沌(deterministic chaos)现象的发现,促使人们寻找这两个极端之间的中间模型。庞加勒(Poincare)在研究天体力学时发现,三体问题不可积(郝柏林1990),没办法用线性扰动理论处理。

我们用线性理论能够解释的只是二体问题,经济学中有解析解的也是二体问题,因为二体问题可以用一个数学变换化为一体问题。比如地球围绕太阳转的行星运动,只要以质心作座标系作一个坐标变换,就变成了一个一体问题。行星运动的椭圆轨道在沿轨道平面上的纵轴上投影,就化成钟摆的一维运动。微观经济学中的艾奇沃思盒(Edgeword box),国际贸易中的比较优势理论,都是依据二体模型所作的推论,对三体问题未必有效。

三体加进来之后,这个系统有没有解析解,是否稳定呢?这个问题很深刻,关系到多体问题的可积性问题。如果这个系统是可积的,可分离变量,那一定有解析解。多数人猜测三体问题肯定有解析解,也可以用简单系统的叠加来近似,结果他们猜错了。

后面我们将看到,不可积性的发现是混沌(chaos)研究的起点。计量经济学家所喜欢的回归分析,其理论基础也在于系统的可积性。不可积性的普遍存在将动摇古典计量经济学的理论基础。

(4.2) 非线性机制和混沌现象的研究

和突变论几乎同时起步,但迟迟才被科学界承认的研究是混沌现象的发现。也在1963年,麻省理工学院的洛伦茨在研究气象预报方程的数值解时发现了混沌现象(Edward Lorenz 1963)。流体力学的浅水波方程可简化为非线性的常微分方程组。大家知道,牛顿力学方程是线性决定论的常微分方程组,只要给定初始条件,系统的轨道完全能够被精确预言。但洛伦茨用计算机处理,发现如果是非线性系统的话,初始条件只要变动十亿分之一,这种以往可以忽略的扰动,会被不断放大,使得在一定时间尺度之外的系统轨道完全不可预测,这说明系统非常的不稳定。这种对初始条件高度敏感的决定论的不稳定现象,后来在生物学、化学中也相继发现,被数学物理学家命名为决定性的混沌(deterministic chaos),简称为混沌。

应当指出,混沌这一说法很易引起误解。最先取名的数学物理学家过分强调混沌现象中无规则的一面而忽略其中有新规则的一面。应当强调的是,混沌不是无序而是更高的秩序。人们一说混沌就以为是灾难临头,就是动乱暴发,其实更确切的说法应当是非线性振荡(nonlinear oscillator),我们在经济波动的研究中主张采用复杂周期(complex cycles)或不完美周期(imperfect cycles)的提法。比如说心跳便不是钟摆,心跳可视为一个非周期的振荡,频率有一个很窄的摆动,这种运动和钟摆相比是一种更高级的秩序。

这里有一个很有趣的事情,三似乎是复杂系统的一个关节点。数学上我们知道,就常微分方程系统而言,混沌现象产生的必要条件是系统的维数必须大于或等于三。搞天体力学的人发现,任意放三个小行星在系统里任它们旋转,最后的稳定形态一定是只剩下二个行星的组合,第三者最终被抛出去(Szebehely 199?)。社会心理学家注意到,组织形态和组织大小有关,二元组和三元组的行为有质的不同(Hare 1976)。比如让学生们在教室里自由讨论,二个人会讨论得很亲密,三个人就会产生权力斗争,增加到五个以上就可能分成二个子系统,再加人会产生更复杂的系统结构。研究通讯和组织理论的社会学家观察到,一个复杂系统大到一定程度以后,便会分解成几个相对简单的子系统。

由此可见,企业的组织形态和劳动分工是一个在实验观察和系统数学上都很有趣的问题,而对这个问题的探讨有很多不同的途径。不同学科不约而同的观察使人们意识到复杂性问题的普遍性。比如说,二和三的差别可能是简单系统和复杂系统之间的第一个关节点。

(4.3) 非平衡演化的研究

最有趣的事情是意识到非均衡的存在,非线性本身带来一个多稳态。如果只有一个稳态,则可以作优化;若有多种可能的状态,势函数有好几个凹坑或凸包,在几个点跳来跳去,这就是一个多稳态了。但结构为什么会演化这个问题单单引进多稳态是不足以解答的。这个问题的启示从负熵开始,物理学家开始意识到热力学第二定律不是普遍合理的。普里高津对非平衡态热力学有非常重要的贡献,他在“演化的热力学”一文中将所有系统分成三类:孤立系统、封闭系统、和开放系统(Prigogine et al. 1973)。三者的演化方式完全不同。

如果是一个孤立系统,热力学第二定律成立。时间箭头只有一个:人总要死的,差别总会消失,演化的规律一定是从有序到无序。放一杯水,温差最后一定消失到和周围环境温度一样,但这个规律只对孤立系统成立。

一个封闭系统可以交换能量,在经济学上就是可以买卖,但要素与人口不能流动,信息也不能流动,那是一种什么结构呢?那是一个静态结构。最简单的静态结构是晶体。放一杯盐水让其降温,开始时看不见结构,后来小盐块结晶出来了。这种静态结构能否解释经济和生命系统呢?严格说来不能,近似还可以。在城市研究、开放经济中就会用到晶体模型。但真正研究生命演化这类问题必须在开放系统中处理。开放系统的定义就是同时存在能量流、信息流、物质流,三者缺一不可。对人体来说就是需要消耗与补充能量流、物质流和信息流,光有存量不行。这种结构就叫耗散结构,因为这种结构的维持要不断消耗物质、能量和信息。

中国人最早的演化观是退化论。孔子“今不如昔”的观念颇与古典热力学的孤立系统理论相近,其原因可能和中国农耕民族对黄河流域的生态破坏有关。佛教的传入把循环论的演化观带进中国。进化论向上的时间箭头的概念是犹太人的贡献。犹太人相信未来比现在好,演化是进步,先进要战胜落后。这是一种单向或线性的时间箭头。

复杂系统的演化观没有这么绝对,因为非线性、非平衡将多向性与多样性引入演化。演化的结果,可能变好,也可能变坏。如果你认为演化只有一种可能性,在计划经济中领导会考虑一切,民间的主动性就没有了;如果在市场经济中看不见的手会自动达到最优,那么游戏规则的制定、产业政策的协调也不用做了。这都不符合当代各国的历史经验。现在我们发现历史演化路径的选择面临的不是均衡理论预期的平原,而是山峦起伏的风景(landscape)。不可能有唯一优化的捷径,山与山、谷与谷之间未必有路可通。你今天认为这条道路是优越的,到明天别人就可能发现另有新径了。

值得注意的是,斯大林的历史观是单线的,马克思的历史观却是多线的。马克思把历史演化看成是一个台阶式过程,从原始社会、奴隶社会、封建社会、到资本主义社会。马克思对亚细亚生产方式的讨论明确表达了亚洲和西欧历史演化的不同。

我们来考察新古典经济理论属于什么样的热力学系统?历史上,一般均衡理论正出自古典热力学的影响(Mirowski 1989)。新古典经济学的代表者模型属于孤立系统的一体模型,包括弗里德曼(Friedman)的货币中性的岛屿经济模型,和卢卡斯(Lucas)的理性预期理论。科斯(Coase)的交易成本说是个二体模型。古典和新古典经济学的主要特点是强调竞争过程的趋同性和市场经济自身的稳定性,却忽视结构的多样性、市场波动的不稳定性和演化的多向性。

(4.4) 非稳态过程的描写

如果你承认有非线性,还有非均衡,那么一定会有时间相关的非稳态。稳态通常是描述随机过程的,我们现在学的时间序列的数学分析,数理统计教的相关分析,其背后的假设都是一种稳态系统,如果是非稳态系统就不能操作了。

爱因斯坦相对论的一个非常重要的贡献,就是发现时空不可分割,测量的同时性是有条件的。我们研究经济波动时发现,测量时间和测量频率不能同时测准,必须构造一个更高维的空间:时间-频率空间来研究时间相关的频率演变现象,就象医生研究病史一样研究频率的演化。物理学家伽宝建议了一个时间-频率的二维表象,对我们做经济学诊断有很大用处(Gabor 1946)。

传统的经济波动理论用机械钟(谐振子模型)或白噪声(稳态随机过程)来描写经济波动,把持续的经济波动归之于外来噪声冲击的结果,否定经济内在的波动机制。因而他们不能处理结构演化引起的经济运动。我们采用时间相关的非稳态时间序列分析方法,就会发现经济系统象生命有机体一样,有自己的生命节律。经济波动和经济系统的新陈代谢机制是不可分割的(Chen 1996)。

(4.5) 稳定与复杂、安全与机会的消长(trade-off)关系

前面我们讨论了稳定性和多样性。现在要问,这二者的关系如何?这一问题最早是由生物学家而不是经济学家提出来的。但这问题对经济学家十分重要。中国经济改革面临的一个首要问题,就是稳定与发展的关系。

东欧和前苏联推行的休克疗法把稳定放在第一位,以为只要实现市场稳定,经济就会增长,并自动实现资源分配的最优,结果经历了战后最严重的经济萧条。东欧经济下降过程中,货币物价很难稳定,最后虽然稳定下来,但代价高昂。中国前十几年的改革把发展放在第一位,和休克疗法的指导思想相反。结果中国人取得成功。我们发现,在经济增长过程中的价格改革和结构调整较易进行。相比之下,中国目前经济失序的问题在于中国金融改革的滞后,中国金融改革滞后的一个原因是在指导思想上害怕金融秩序失稳。其实越是害怕失稳问题就越多。

由此可见,稳定和发展是一个非常重要的问题。到底二者是什么关系呢?理论生物学的猜测是一个系统越复杂就应该越稳定。这想法是从达尔文理论的逻辑来的。达尔文理论有一个著名论断叫做适者生存,而且是最适者生存。虽然达尔文没有明确说最适者便是优者,但他最适者生存这个说法,可以自然推广为生存者即为适者,最适者定为优者。优者是什么?

从控制论的观点看,优者就是稳定。假如你综合达尔文的进化论和控制论,你一定会猜测系统在从简单到复杂的演化过程中,应该是越复杂的系统越稳定。但是控制论学者作的大量计算机模拟,得到的结果和原先的猜测相反,他们发现系统越大越不稳定(Gardner and Ashby 1970)。这一结果使生物学界大为哗然。理论物理出身的理论生物学家梅依做了一个很重要的改进(May 1974),设计了一个非线性系统,结果还是越复杂的系统越不稳定。让理论生物学家大伤脑筋。

我们从系统复杂性问题的反思出发,承认数学模拟结果的天然合理性:因为生物和社会的大量观察表明:增加复杂性会降低稳定性(Chen 1987)。科学匠和科学家在方法上最大的一个差别在有无创造性的思维。科学匠不问问题便在那里忙着算,你算小数点后面二位,我算到八位,就自以为有成就了。但是创造性思维的科学大家偏要问基本的问题。而科学的基本问题往往是从简单的观察中产生,而不是从前人的思维中去获得的。微观经济学的阿罗一德布罗模型数学上那么简单漂亮,但股票市场一崩溃,人们对它的信念就动摇了。单有稳定性不能解释经济波动和股市崩溃。所以生物学家和经济学家都要问一个共同的的问题:系统到底越复杂越稳定,还是越复杂越不稳定?

科学史上有一个教训,如果人们前赴后继的探索总是得到一个否定的答案,是不是应当承认现实,把结论倒过来:原先认为不对的是正常的,原先认为应该对的反是不正常的。这种例子很多,永动机不可能,于是产生了热力学第二定律。光速传播无限的不可能,产生了狭义相对论。我们接手这个问题时,一个自然的思路是倒过来,越复杂的系统只能是越不稳定。我们联想许多生活中的常识更发现这一结论必然是对的。例如,简单生物的再生能力非常强,蚯蚓一截二还可再生为二条蚯蚓,一个高等动物一劈二就完了。再如纽约一百十几层的贸易大楼炸一个炸弹或断一下电,整个楼就乱套了,日军飞机在中国农村扔几颗炸弹没什么了不起。这是中国的游击战能在农村打败机械化的日军在系统学中的道理。所以复杂性和稳定性的矛盾颇象是鱼和熊掌不可兼得的关系,两者此消彼长,不可兼得。

【五.均衡经济学面临的局限和挑战】

均衡经济学在引入数理方法来描写经济社会有开创性的贡献。她架起数理科学与人文科学之间的桥梁。均衡经济学对市场稳定性的机制,例如价格竞争和技术传播的收敛趋势,作了有用的研究。然而,本质上均衡方法只对封闭系统有效。均衡经济学的许多描述,例如微观经济学的岛屿经济,产权经济学的二人交易,可以近似描写前资本主义的物物交换市场。但开放经济的现代市场是一个远离平衡的复杂经济系统。本质是静态的均衡经济学模型在定量描写演化经济的变动时,就面临难以克服的困难。

均衡经济学的理想世界是一个没有差别、没有结构、没有记忆、没有历史、也没有变化的世界。经济结构的产生是由于摩擦力,例如交易成本或税收,而非内生的非线性非均衡机制。和生物学的演化观相比,均衡经济学的宇宙观是一个典型的牛顿力学的机械观。1989年柏林墙拆除以后,有一个美籍日本人福山(Fukuyama)预言说历史将要终结了,世界各国以后都将进入一个无聊的无差别的资本主义世界。这是典型的均衡思维。他不承认冷战后的大趋势是全世界多样化的发展。

林毅夫对中国经济学家寄予厚望,希望中国人有可能在二十一世纪的诺贝尔经济学奖。经济学研究能否有所突破,关键是你能否把现实中观察到的问题和经济学的基本问题联起来,证明它或否定它。发现问题比解决问题更困难。

科学史上,把握科学突破的关键问题需要远见和勇气。当二十时纪来临时,曾经有两位大科学家对当时科学的问题和未来发展的方向,作了大胆的预言。一位是发现热力学第二定律的英国物理学家开尔芬。他乐观地宣布经典物理学的大厦已经建成,然而天空有两朵乌云。五年之后,这两朵乌云变成相对论和量子力学的两股风暴。还有一位是德国大数学家希尔伯特,他列出.. 23个数学上未解决的问题,成为许多青年数学家努力的目标。

从此之后,自然科学界每过一个时期,都会用科学界的集体努力,对当时科学的前沿作一调查,以指导科技政策。如今二十一世纪即将来临,经济学的前景如何呢?1991年英国皇家经济学会借经济学杂志(Economic Journal)一百周年之机,出过一期专刊,回顾过去百年经济学的进展,预测经济学下一个百年可能的发展。十几位有影响的经济学家发表了自己的预测,其中不乏真知灼见,建议同学们一读。可惜里面的从传统理论出发的个人感觉太多,从新角度明确提出的研究问题太少。

苏联人造卫星发在美国之先,曾在美国引起一次科技政策的大辩论,刺激美国进行了一次彻底的教育改革。加州大学出过一套非常好的普通物理改革教材,鼓励学生发现问题、思考问题。比如教电学的库仑定律,两个电荷之间的作用力和它们的距离平方成反比。传统的教科书陈述这一实验事实就完了,而这本改革教材上来先对库仑定律是否成立打了一个问号,然后介绍科学家检验非平方反比律是否成立的实验,给出库仑定律成立的空间尺度( Purcell 1965)。这是非常好的教育方法。假如我们想问类似的问题:经济学的规律成立到什么程度?

几乎看不到经济学的标准教科书有定量的讨论。举例来说,公司金融理论说股票价格的基本面应当由未来收入流的贴现值决定,利率升高导致机会成本升高和现值下降。问题是对未来收入流的预期时间尺度到底该多长?

中长期投资者也许会看5年,短期投机家只顾几个月。对美国股市的历史数据分析发现,如果以5年为期来计算平均的股份收入流,只能解释股票现值的.. 20%左右;如果以.. 25年来计,也只能大致解释到.. 75%。不同经济部门股票走势的差别更大:若以.. 8年为期计算,烟草行业的折扣收入流能解释股票现值的.. 44%,运动器材只能解释.. 19%,皮肤保健品几乎是.. 0%,在高科技领域的比例竟为-25%看好,股价仍会上涨。因为高科技领域注重战略决策,初始几年的投资可能根本没有回报(Copeland, Koller and Murrin 1994)。均衡理论的误差可见一般。

所以我们对西方主流经济学的介绍,要取科学客观的态度。从70年代开始,主流经济学中几乎所有的领域都陆续发现理论不能解释的经验困惑。微观经济学是高度公理化和自洽的理论体系,其理论基础是仿效古典力学的哈密顿形式体系-理性假设和优化原理。但在实践上,理论和观察存在很大的差距,越来越多的心理学和实验经济学的实验,挑战微观经济学的基本假设和适用范围。

宏观经济学的困难在如何从演化的经济中寻找稳定的规律。计量经济学的回归分析方法,在处理复杂经济系统上面临深刻的困难。这些疑难从方法论而言,主流经济学的方法基于四个基本假设:即线性、均衡、稳态、和单体问题(二体问题数学上可以化为单体问题)可以用本文开始的说法来概括,说穿了就是这样四个方面的问题:非线性、非均衡、非稳态。和多体问题(亦即集合行为)。从经济学理论和实践的冲突来观察,则表现在微观经济学、宏观经济学、和计量经济学的各个方面,我们略举若干例子,给大家思考。

(5.1) 非线性效用函数和多稳态机制

微观经济学中的效用函数假设人的欲望无穷,消费越多越好。但世界上没有一样东西是越多越好,吃得太少或太多都要得病,住房太大不但在经济萧条时面临大幅贬值的风险,而且在心理上给人造成空虚和恐惧感。

实际的效用应该是数量的非线性关系,适度区域和历史条件有关。许多貌似“无理性”的经济行为,在一定的生态文化约束下,是十分合理的选择。这就必须修改微观经济学的优化理论。

我们讨论行为经济学问题。凯恩斯一个巨大的贡献就是把心理学引到经济学中来。现在的心理学可以做实验。关于人的经济选择是否是理性的,在八十年代心理学家和经济学家有一个大辨论 (Hogarth and Reder 1988)。最开始发起挑战的是诺贝尔经济学奖获得者心理学家西蒙,他认为人的理性是有限的,人脑不可能处理非常大的信息(Simon 1957)。行为经济学家的实验发现了固锚(Anchor)效应(Kahneman, Slovic and Tversky 1982)。

人的思维不是一个理性选择,把所有选择平等衡量。人们选择的偏向象一个船锚那样固定:船在海上漂荡,总围着那个锚的附近转,相对预定的目标调整。卢卡斯辩解说,理性选择指最后的结果可以用优化模型来比拟。但假如选择的对象是三个而非两个,优化理论就难以给出和观察一致的结果。

均衡金融理论最漂亮的一步是资产定价理论。均衡定义为无套利机会存在。Ross进一步证明,无套利机会等价于线性价格关系(Ross 1976)。这就指出均衡理论的限制。假如利率对所有人都是一样的,而且是一个常数,不随时间改变,那么均衡价格就可以存在。在中国,利率表面上对所有人相同,因为官方利率没有市场化。实际上灰色利率因人而异,塞红包吃回扣,套利机会鼓励了腐败行为。西方金融市场即使是公开竞争,利率也不会一样。你的信誉差、负债率高,风险大,你的利率就要比别人高。另外,规模效应可以降低出售者的市场风险,所以批发商愿意对大量的买主打扣折。凡此种种都是非线性价格。如果是线性定价,你就有均衡解。如果是非线性定价,就没有均衡解。

与此相关的是公司金融理论中的MM定理。该定理断言在完全竞争条件下,公司的资产价值和债务结构无关,也和公司的红利政策无关。这和市场经验相矛盾。原因是MM定理的核心假设是线性利率的存在保证无套利机会。这对非稳态经济波动下的金融市场并不成立。

(5.2) 企业层次的规模递增和有限竞争

劳动分工、规模递增的现象直接和优化概念相冲突。要有优化解就必须是凸函数,凸性被破坏情况下又会怎样,其实是多均衡的问题。英国皇家经济学会纪念经济学杂志一百周年的专刊中,有一篇文章专门讨论对现在正统的Von Neumann的预期效用函数的修改方案,讲到非凸性、非线性、非传递性的预期效用函数的种种可能方案(Fisburn 1991)。

微观经济学保证优化解存在的一个要求是均衡经济不允许规模递增。但规模递增是劳动分工发展的一个重要因素。福特引进流水线大规模生产汽车,证明企业层次的规模递增是不可否认的经济效应。目前经济学妥协的结果是只承认规模经济对产业和国家的层次存在,而继续保留企业层次的优化原理。

规模递增首先在国际经济学中得到承认。克鲁格曼观察到国际贸易中的“反常现象”:发达国家之间的贸易量远远超过发达与不发达国家之间,这不符合古典经济学的比较优势理论。克鲁格曼用规模经济和垄断竞争作了一个很好的解释(Krugman 1979)。为什么日本车出口美国呢?因为汽车产业要大量投资,规模越大成本越低,竞争的目标不是追求最大的利润,而是追求最大的市场份额。引进规模经济到国际贸易中来首先就打破了一个概念,原来认为竞争只有两种类型:要么垄断要么完全竞争,事实上完全竞争是不可能的,垄断竞争也是不现实的。应该进一步研究有限竞争。市场、自然资源的占有是有限的,对质量、安全的标准也要求对市场的进入有所限制。所以,合理的竞争行为应当是在完全竞争与垄断竞争之间的有限竞争或适度竞争。

规模递增也被引入内生的增长理论。索洛的新古典增长理论预言所有国家的增长率有收敛的趋势(Solow 1970)。卢卡斯注意到各国经济增长率的发散性,然而又不愿放弃优化原理,只能承认规模递增对整个国家可以成立,而在微观来说对企业没有意义,这样以折衷的办法保持优化原理(Lucas 1988)。他们的思想方法颇象二十世纪初的德国物理学家普朗克,他发现了量子现象,却拼命想让它在古典力学的框架内来加以解释。

(5.3) 信息模糊和不确定风险

信息不对称在微观经济学是一个很有名的问题(Akerlof 1970)。有趣的是,斯蒂格勒等人给出了一个证明:假如忽略信息成本的话根本就没有交易,阿罗一德布罗模型描写的不是市场经济,而是自给自足经济(Autarky) (Grossman and Stiglitz 1980)。

信息问题在金融业最为严重。信息不对称导致道德风险(moral hazard)和反向选择(adverse selection)。西方经济学家常常把不发达问题归之于发展中国家缺乏金融市场。但是就在发达国家,银行也是嫌贪爱富,只愿意贷款给,把钱借给最不需要的有钱人,而不愿意贷款给穷人,因为后者没有财产可担保。与此相联的现象就是对利率来说银行有一个信用配给现象(credit rationing)。商品卖方总是卖给出价最高的人,但借钱银行并不敢借给出利息最高的人,因为借钱者可能根本不想还。这些借款的人他知道自己不会还钱,而银行不知道,所以有一个信息不对称问题。这个问题在中国非常严重,中国经济现在增长很快,可是信用瓦解,经济秩序混乱,一个很大的问题就是信息不对称。中国没有一个信用制度,没有一个经济档案制度,今天骗这个明天骗那个。在信息缺乏情况下的竞争是一个反向淘汰机制,赚钱的人可能不守法,守法的被坑蒙拐骗。

但是微观经济学的信息成本理论引进信息成本的概念,并不足以讨论信息经济学中不确定性引起的不稳定性。信息不对称是一个静态的观点。其实很少有一开始就是不想还钱的坏人;如果你这种制度安排下搞一个拔改贷,搞得原来好的企业也不能生存的话,狗急也要跳墙,本来不违法的逼他们违法。他们的行为是守法还是违法,是一个动态的问题,演化的问题。美国八十年代搞的金融解规,因为放松了金融监管,结果出现储蓄贷款银行的严重危机(S&L debacle)。

风险测量的基础是方差。如果服从高斯分布,平均值是有意义的,方差是有限的,这种情况下一定会得到均衡解。奈特和凯恩斯指出不可预测的不确定性的影响(Knight 1921, Keynes 1925)。奈特明确区分考虑统计确定的风险(risk),和统计意义上不可预测的不确定性(uncertainty)。微观经济学讨论的不确定下的优化行为(optimization under uncertainty),其实只考虑统计确定的风险,用的是平均值和方差不变的高斯分布。目前没有有效的方法测量奈特意义下非不可预测的不确定性所引起的信息模糊。这涉及到在微观经济模型中对宏观经济波动影响的考虑。

在金融理论中做得最漂亮的是期权理论。前面指出一个复杂系统需要多个变量,在期权理论中未定参量只有一个-股价变动的方差。数理经济学理论真正对操作发生影响的是期权 (Black and Scholes 1973)。他能够把金融中很多的变量最后压缩到大部分可以从观察中定量,比如股票价格,相应的风险利率,交易的时间间隔等,从而可以计算期权价格。但市场交易中观察到的分布不是这样,方差不是常数,股价变动率(volatility smile)随时间“微笑”(Rubinstein 1985)。这是目前金融理论中的一个重大问题,需要对金融的非线性、非均衡、非稳态现象作深入研究。

(5.4) 多体问题下规则相关的市场行为

均衡经济学的基本框架是单体问题,不考虑社会群体的集合效应。数学上二体问题可以化为单体问题。所以微观经济学的基本模型,只限于二体问题。三体问题的结果就可能大不一样。典型的例子包括国际贸易理论只讨论两个国家、两种货物的交易。宏观经济学的微观模型用一个代表者试图描写行为相同的经济人组成的宏观行为。这些模型在解释非均匀结构和非一致行为时就面临困难。多体问题可能引起的重大困难应当属于制度经济学的领域,因为制度的产生和演化本质上是社会而非个人行为。近年来影响颇大的产权经济学,其理论基础是科斯的二人讲价模型 (Coase 1988)。

交易成本理论为制度经济学奠定了均衡理论的经济学基础。产权经济学断言,市场看不见的手会自动选择最佳的制度安排。产权经济学认为理想的市场经济是没有摩擦力的,企业组织的起源是为了降低摩擦力。科斯定理的猜想是,如果你观察到的制度安排是和你的初始条件,历史条件没有关系,就一定会有一个均衡解。原先的交易成本理论是在对市场经济的观察中提出来的。张五常把它推广到前资本主义世界中,虽然前资本主义没有完全竞争的市场条件。比如租佃率这样的制度安排应该和初始条件没有关系。张五常做了一个大胆推广,如果你观察到的地租率都是.. 50%,那地租率就是收敛的,均衡的,所以全世界的均衡租率都应该一样。他推论说台湾战后的减租和土地改革是降低效率的,因为破坏了均衡(Cheung 1969)。均衡论忽略结构和演化的倾向可见一斑。

产权的均衡理论只说了一面之理。奥地利学派一直强调市场经济的生产过程。很多新技术的发展,并非是市场上已有零部件的组装。交易成本只是企业家考虑的一个战术方面。战略上,尤其高科技的新企业,意在由不同专长的合作,会创造以前不能想象的合作潜力。劳动分工的整体趋势是增加复杂性,从而增加能量的耗散,目的是在整体上创造负熵,创造价值,不只是在局部上降低成本。各国制度的极大差异表明,制度演化并无收敛趋势(Olson 1996)。制度安排和竞争结局一样,是和历史的路径相关(path-dependent)的。实验经济学的研究进一步指出市场行为的规则相关。可见,制度演化和选择是典型的非线性、非稳态的机制。

交易成本说有几个隐藏的假设:第一,工业组织是无限可分的,组元之间的合作效应可以忽略。第二,二体交换的价格和社会背景无关。这两个假设对劳动分工导致规模(scale)、范围(scope)递增的企业都不成立(Chandler 1995)。第三,交易合同的签订忽略不可预测的不确定性带来的合同的非完全性。在现实社会里,道德永远是法律的补充,因为不确定性产生软合同的道德,稳态过程才保证硬合同的效用。

科斯虽然提出一个好的问题,在方法上却给出令人误导的结论。他们认为资本主义的产权制度最终应当是普遍有效的,无论历史和社会条件有何不同。交易成本说不能解释工业化过程中,政府作用的增加和中介服务机构的增加。美国近年总统竞选的一个热门题目是司法制改革,因为美国的律师之多官司之盛,严重影响了美国经济的国际竞争能力,集团利益在过度的私人产权下使公共利益受到严重损害。即使就企业界而言,美国相对西欧日本的交易成本,有明显上升的趋势。小政府社会成本的减少未必能补偿私人监督成本的增加。断言企业发展和社会制度演变的动力仅仅是降低摩擦成本缺乏深刻的理论基础。以个人理性为基础的交易成本说不足以解释以集合行为为基础的社会理性。

(5.5) 李嘉图(Richardo)-列昂惕夫(Leotieff)佯谬

微观经济学和宏观经济学的矛盾,在微观经济简单加总后得到的宏观行为和观察矛盾。在微观经济学中,有一个均匀齐次定理或欧拉定理的应用,例如供求函数是零阶齐次函数,利润和成本函数是一阶齐次函数等。如果没有这个均匀齐次假设,均衡解优化解的存在就无法在线性理论的框架内讨论。宏观经济学中,货币学派的货币中性理论的微观基础也就是这个均匀齐次假设。列昂惕夫曾用供求函数的零阶齐次定理来反对凯恩斯的宏观经济理论。他认为只要货币是中性的,持续的失业就不可能存在(Leotieff 1936)。按照物理学中以提出者的名字命名的习惯,我把这个问题称之为“李嘉图(Richardo)-列昂惕夫(Leotieff)佯谬”。问题是,均匀齐次定理根据的是理想实验,并无经验检验的依据。原因是均匀齐次定理否认经济结构的非均匀性,自然和宏观的观察矛盾。

微观基础与宏观观察之间的矛盾有一个著名的佯谬,叫股权回报之谜 (Mehra and Prescott 1985)。公司有两种金融资产,一种是借来的钱,另一种是股票。股权有一个回报率。人们为什么去买股票而不把钱存在银行里,因为平均来说股市回报率要高于银行里没有风险的利率。如果整体经济处在一般均衡,将投资行为和消费行为联系起来,可以算出每个人的均衡消费,也可以计算股票市场的平均回报率是多少,结果发现股票市场的回报率高得不可思议,比均衡理论估计的高了30多倍。要解释这么高的回报率,不引进非均匀的经济结构和经济行为是不可能的。..

(5.6)参照系的时间尺度:长期与短期均衡如何界定

经济学家一直认为短期均衡是没办法确定的,但长期均衡应当可以知道,假如经济波动有收敛趋势。实际上恰恰相反,技术革命的进展使长期经济预报几无可能。例如弗里德曼提出的所谓自然失业率,到底应该是多少,对美国而言,五、六十年代说是.. 4%,八十年代说是.. 7%,西欧长期在12%左右。其实开放经济不可能有长期均衡(long-run equilibrium),而只能有移动中的均衡(moving Equilibrium)。和均衡经济学的信念相反。经济预报和天气预报一样,可能做短中期预报,不可能做长期预报。

计量经济学在八十年代所谓的单位根革命(unit-root revolution),把线性理论推到边际稳定性的极端(Nelson and Plosser 1982)。一个离散时间的经济系统如果处于稳态,它的时间序列的特征根应该在单位圆之外,使外来冲击必然衰减;如果在单位圆之内经济振荡就要爆炸。我们观察到的经济系统总在那里振荡,又不衰减又不爆炸,怎么描写呢?计量经济学家认为特征根只能在单位圆的边界上。

单位根模型是结构不稳定的系统。系数稍微扰动一点,不是爆炸就是衰减,总之无法维持持续振荡。在数学上,单位根的存在等价于非线性趋势 (Bierens 1995)。最简单的例子是分段线性的趋势转折模型,例如石油价格冲击造成GNP增长趋势的扭转,会造成统计检验的单位根假象(Perron 1989)。

(5.7) 经济波动的起源:内生节律还是外来驱动

宏观问题最核心的就是经济波动的起源。哈耶克认为经济波动本身就是对均衡理论的最大挑战。但卢卡斯想改变问题的提法,把有节律的经济波动视为无规则的经济噪声,便可纳入均衡经济学的框架(Lucas 1981)。

卢卡斯的贡献在恢复对经济波动的定量理论研究。我们早就知道,经济波动中各个经济成分的幅度并不一样,消费行为过份光滑,投资行为过份动荡。真实经济波动学派(real business cycle school)对这二者的解释作了不少有趣的工作。但随机过程的稳态理论对解释市场崩溃这样的现象束手无策。需要引进非线性动力学的机制。

我们发现如用非线性趋势观察周期波动,会观察到频率相对稳定的经济波动。而频率移动的不同方式,给结构演化的诊断提供许多有用的信息。非线性振荡或称色混沌给持续经济波动提供了自然的内生机制的解释。

经济波动有如生物钟,只能是非线性振荡。不同经济成分,例如投资、消费、和股市运动,有各自不同的频率特征,经济周期的“个性”并不相同。

(5.8) 测不准关系和动力学复杂性

经济学家已经注意到金融市场内生的不稳定性。交易者看见股价涨是买还是卖?如果是理性交易者,在均衡情况下应该卖,假如市场能迅速回归均衡;但多数投机者会继续买进,因为投机者预言市价走向会继续看涨,当然涨势总有回落之日。非均衡市场中成功的投机者会把握时机先买后卖赚取差价。在市场风潮成形时,维持市场均衡有很大的风险。负责平衡市场的监督者假如资产有限,他反而变成带头投机的人(Shleifer and Summers 1990)。传统经济学用两阶段的马尔科夫过程描写股市风潮的涨落趋势,其弱点是不能描写拐点(时机)的不确定性。

信号处理的测不准关系规定时间和频率两者不可能同时分辨精确。投机也有很大风险,因为股市升降的转折点是不可精确预见的。经济波动中经常观察到的过度反应和时机不确定性密切相关,这和理性预期理论断言相反,社会心理的集合效应是经济周期波动的重要来源。

(5.9)不可积问题动摇计量经济学的基础

现在计量经济学广泛依赖参数回归方法,其前提是经济系统是可积系统。此外还必须是稳态系统,使系统解析解的系数须不随时间改变。我们已经知道,绝大多数的动力学系统是不可积系统,不存在解析解。如果这个系统根本不可积,那么猜测函数的解析形式,用观察数据作回归分析就失去意义。这就要求我们发展分析非线性、非稳态的新的数学工具(Chen 1993, 1997)。

【六.研究科学方法、避免前人弯路】

中国的启蒙运动家,在本世纪初,对引进西方学术思想,作了可歌可泣的贡献。可惜的是,他们在救亡的危机之中,呐喊有余,分析不足。只注重引进结论,不注重研究方法,在若干基本问题上,犯了用传统观念曲解科学思想的概念性错误。就现代经济学引进中国的历史而言,错误影响深远者大体有三:

(1) 严复介绍达尔文理论,不译达尔文原作,而译赫胥黎的伦理学小册子,不仅开中国把科学理论加以意识形态化的先河,而且将“演化论”误译为“进化论”;梁启超进一步将生物多样化的演化曲解为“优胜劣败”的单向进化,他们对达尔文理论片面宣传,造成的广泛误解至今存在;孙中山认为,中国灭种的危险,在于中国近代的人口增长率低于英美,毛泽东认为,迟迟认识人口控制的重要,都可以追溯到严复、梁启超的影响。中国知识分子长期忽略经济技术问题的基础建设,对文化传统的批判付出过高的代价,是和中国早期启蒙运动家对科学的急功近利态度有关的。

(2) 国内对马克思分配原则“各尽所能,各取所需”的翻译不仅是不确切的(伍铁平 1979),而且是违背经济学常识的。马克思的原意是客观的操作:“按照”能力,“按照”需要,进行分配。但我们译成“尽”其所能就成为主观愿望了,你工作再努力,也可能被人怀疑没有尽力。我们在大跃进时宣传说,将来到物资极大丰富时,就可以各取所需了。这在技术缓慢变革的农业时代说得通,在技术飞跃变革的工业时代却是说不通的。

假如说吃饱饭就满足,只要粮食足够,也许不难“各取所需”。但生存必须以外人的消费欲望却永无止境,十年前满足的自行车,现在就会想小汽车,以后还会要专用飞机。经济学的基本出发点就是资源有限,但技术创造无止境,所以人的欲望也是无限。这才需要经济学家“按照能力,按照需要,进行分配(马克思的原意) ”。分配的办法可以多种:抽签,按能力,按地位(年资,权力,财产,功绩), 按需要(如按病急程度分配医疗次序)等等。如果任人自取,无需分配,经济学也就不存在了。其误导之处不仅助长了共产风的错误,也使我们很长时期不注意可操作的制度建设,用思想教育代替经营管理和市场机制。在中国经济改革举世瞩目的今天,应该进一步提高理论总结的水准。

(3) 目前国内流行的对凯恩斯名作“The General Theory (of Employment, Interest, and Money)”的译名“通论”也是不当的。英文“General Theory ”的提法,是凯恩斯比照爱因斯坦“广义(general)”和“狭义(special)”相对论(relativity)的关系,来描写凯恩斯宏观经济学理论和古典经济学的关系的。即广义相对论把狭义相对论作为自己的特殊例子包括在内,狭义相对论又把牛顿力学作为自己的特殊例子包括在内。但译成“通论”就和“泛论”之意差不多,完全失掉了原作的中心思想。把定量描写现代市场经济运作的数理经济学和传统的政治经济学放在一起,纳入为统治阶级辩护的“庸俗经济学”范畴,也不利于我们发展可观察的经验经济科学的努力。

中国早期启蒙运动家的这些缺点并不奇怪,因为中国文化本身缺乏数理经验科学的传统。引进科学研究的方法需要几代人的时间。对今天年轻的经济学人而言,不要崇拜西方经济学家主流学派的结论,认真研究西方经济学各个流派的方法,注意现实经验对理论的挑战,是中国经济学家有可能在二十一世纪有所作为的起点。

【一.引论:科学重心的转移和科学规范的变革】

当代科学正在经历一个划时代的变革,包括科学研究重心的转移和科学思想规范的转变。因为我们正处于变革的过程之中而非变革的过程之末,所以目前使用的一些提法可能有争议。我们的目的是给科学变革的潮流钩画出一个大概的轮廓,使大家能及时把握创新的机遇。任何一个科学学派,总有其特色和局限;读者可以把这里介绍的一家之言和你所接触的其他学派相比较,从而寻找自己的道路。

我这次讲演的中心议题是,当代科学的发展--正从分析科学走向综合科学,世界的演化从趋同走向多样(Prigogine 1980)。认识理解世界的理论框架,也从以平衡或均衡观念为核心的古典静态(几何学)理论走向以非平衡观念为核心的现代演化(动力学)理论。这些变化发生在以计算机和遗传工程为主导的第四次工业革命、或称作第三次浪潮的时代(Tofler 1980),不是偶然的。

下面我们先从当代科学思想演变的基本线索谈起,然后再讨论科学革命的社会历史背景。当然,这两者实际上是相互关联的。

(1.1) 当代科学的三个前沿

科学研究有三个前沿,所谓的三个“极”:极小,极大和极为复杂。第一个“极”是“极小”。如分子、原子、基本粒子等。统治极小世界规律的是量子力学和量子场论。第二个“极”是“极大”。研究天体和宇宙空间。爱因斯坦的狭义相对论和广义相对论,奠定了研究极大的基础。在介于极大和极小之间的时空尺度上,牛顿力学主导经典运动的规律。

两次世界大战和随后的冷战,促使各国政府把主要的研究经费压在了极小和极大的研究上,制造原子弹、导弹、加速器、和空间飞船。二十世纪下半叶,理论物理上一个最重要的突破,就是杨振宁的规范场理论给极小和极大的统一场论开辟了道路。极小和极大的研究,从基础到应用的周期很长,所以,其基础研究经费主要靠国家的军费支持。尽管对科学家来说,极小和极大的研究具有永恒的魅力,冷战之后军费的大幅削减,使这两方面的研究规模近年来大为缩小。科学研究的重心,正向生物学和经济学转移。这就引向科学的第三个前沿。

这第三个是最古老、最困难、在本世纪投入也最少的领域。它处在极大和极小之间,和我们人类特定的空间和时间尺度处在同一个量级上,这个领域可称为“极为复杂”。生命和社会系统的研究,比物理化学系统困难得多。经济学家面临的挑战,远比物理学家严峻,因为经济系统正是最难处理的一类复杂系统。在研究极大、极小这二个领域上发展起来的古典物理学,在解释生命和社会现象时,就碰到了非常基本的障碍。我们可以说:科学史上下一个最大的挑战、或最大的希望,就是这个“极为复杂”的领域。

(1.2) 科学从分析到综合的发展

西方科学的主流是从希腊原子论到现代基本粒子论为代表的分析科学。我们今天讲的新兴的复杂系统科学(science of complexity), 或称复杂系统(complex systems),七十年代还有一个名称,叫自组织理论(self-organization theory)。她是与西方传统从希腊原子论到现代基本粒子论为代表的分析科学相对立又互补的研究路线。

主导极小和极大的物理理论,都源于希腊的原子论和几何学。原子论的基本思想是复杂事物可以分解为简单组元之和。假如简单组元的运动规律相对简单,而组元之间的相互作用可以忽略,使它们的整体运动可以简单相加,则复杂事物的运动规律,可以还原为较低层次组元的运动规律。所谓一加一等于二,是线性求和的简单例子。这在数学上,可以方便地用几何图象来描写。牛顿动力学和爱因斯坦相对论的宇宙观,都基于本质是静态的几何学。但是,你假如对活的生物进行分解,就可能改变生物活动的正常状态以致死亡。原因是生物体组元之间的相互作用和相互耦合,比机械运动强得多。所谓一加一大于二,是复杂系统的典型特征。古希腊原子论的分析方法和中国老庄哲学的整体论思想是不同的。近代分析科学成长的一个重要原因是,数学定量描写,首先用于机械运动这样的简单系统。生物学中达尔文的进化论和经济学中马克思的社会演化理论,都没有适宜的数学理论作支持。描写复杂系统的数学工具在本世纪七十年代才获得突破。

“极为复杂”的研究,尤其是对生命和社会现象的研究,基本问题究竟是什么?它有二个令人深思的问题,或者说是一个问题的二个方面(Prigogine 1980):

【第一个问题】是,为什么生物和社会这样的复杂系统能够存在(being)?

【第二个问题】是,这些复杂系统为什么能够演化(becoming)?

从科学思想史的角度看,演化问题是最古老的科学问题。中国的老庄哲学很早就有演化论的思想。老子说,天下万物生于有,有生于无;又说一生二、二生三、三生万物。假如你知道混沌现象产生的条件是自由度大于三,而目前经济学均衡理论的局限,在于优化理论只能处理二体问题,你就会惊叹中国古代哲人的大智慧。

在讨论复杂系统科学之前,我们有必要澄清和复杂科学研究有关的一些误解和提法。所谓科学,严格来讲是指“经验科学”。我不想使用哲学上有争议的“实证科学”的说法。经验科学从方法论而言,意味着可以对研究对象进行观察,并进而作定量的描述;根据观察建立的模型或假说,可以被实验定量地观察和检验。科学研究的方法是从简单到复杂,逐步发展起来的。当代经济学从定性的政治经济学,到定量的数理经济学的发展史,也是数学、物理学、工程学和生物学对经济学思想方法的交叉渗透史。所以我们要在数理经济学上有所创新,一定要关注相邻科学的发展。

中国以前对跨学科的研究,有个源于传统但近乎嘲讽的说法,叫作“杂家”。当然,兴趣广泛的杂家,可能在科学哲学、或者自然辩证法的研究上,对复杂科学的思想作出有益的介绍和评论,但这不是我们今天讨论的内容。我们强调的是严格意义上的复杂科学研究,强调的是科学研究方法上的突破,而非哲学意义上的结论。这点务必请大家注意。

从科学方法上,国内有所谓老三论、新三论的说法,把几个层次完全不同的理论联在一起。老三论包括:控制论、信息论、和系统论。新三论包括:突变论、协同学、和耗散结构论。这种提法,就科学普及而言,也许有助于记忆,但在理论发展的思路上,可能有所误导。从科学方法看,老三论大体上属于线性理论的范畴,基本框架是古典物理的经典力学和平衡态热力学。新三论属于非线性理论的范畴,共同的数学工具是分叉论(bifurcation theory)。

在老三论中,系统论在哲学上发展了和分析科学对立的整体论思想;但在数学方法上,系统论实质上是应用控制论,没有新的突破。在新三论中,突变论是一个有争议的数学理论而非物理模型;协同学只有简化复杂系统研究方法上的设想,在生物和经济研究上,至今未有实质性的突破。系统科学中真正有开拓性贡献的当属控制论、信息论、和耗散结构论。八十年代开始,科学界对这些以非线性数学为基础,以现实问题,从物理、化学、生物、到经济、生活,系统进行研究的新兴交叉领域有个总的称呼,叫做复杂系统科学、或自组织科学,以区别于四、五十年代发展起来的以线性数学理论为基础的系统论。

(1.3) 科学研究方法和科学革命

从我个人的经验出发,我对同学们有个建议,在科学研究中,不要轻易接受已有的理论。马克思最喜欢的两句格言是:“关于人类的事物我都要知道”,和“对于万物都要问个为什么?(这是我的译法,传统的译法是:对于万物都怀疑)”。因为怀疑本身未必有建设性的成果。世俗的怀疑常常是疑而不决、疑而不为,以致存疑终身。

科学的怀疑是问为什么,是分析比较现有的互相竞争的理论,从观察中和论战中,寻找你进一步研究的出发点。这就要去猜测现象背后的机制,用可以观察到的经验事实,来检验你早先的猜测,是对是错。即疑而观察,疑而待决。

对前人的科学成就,怎样去继承和发展?我以为,一要懂得欣赏,知道其成就的关键在何处;二要尝试发展,因为任何高峰本身就是其局限。不懂得欣赏的人,也可以批评,但因不解其妙,批评往往难中要害。我们常常听到西方主流理论的捍卫者答辩说,旧理论的缺点虽多,但并无更好的新理论取而代之。这正是对批评者最大的挑战。真正有潜力的科学理论应当象爱因斯坦的相对论那样,把牛顿力学作为近似包括在新体系之内,而不是简单地否定已有实验基础的旧理论。

下面我们简单地介绍复杂系统研究的基本问题和基本思路。

【二.均衡论、控制论、和系统稳定性的机制】

从四十年代开始,对生物和社会现象感兴趣的科学家,主要关心的是【第一个问题】,就是复杂系统为什么会存在?

(2.1) 均衡论、优化论、和势函数

经济学家在经济系统的描述中,引进了稳态或均衡的概念。“稳定”和“均衡”这两个概念是从古典力学和古典热力学中借鉴过来的(Mirowski 1989)。古典力学一个重要的发展是保守系统中,哈密顿力学的优化形式。它对量子力学与经济学的形式体系,有重大影响。对一个无摩擦力的保守系统,牛顿力学的动力学方程,可以从变分原理导出。其中最重要的一个优化目标函数,就是能量。系统处于稳态时的自由能最小。匈牙利数学物理学家冯·诺依曼(von Neumann〕在建立博弈论时,把预期效用函数(expected utility function)引进了经济学(von Neumann and Morgenstern 1944)。经济学中效用函数和生产函数的概念和古典保守系统中的势函数大致相当。哈密顿力学假设在一个没有摩擦力的保守系统中,势函数存在,力学中动力学的轨道问题可以转化为数学上的优化问题。

均衡经济学假设在一个没有摩擦力,也就是没有交易成本和税收等经济摩擦的均衡经济中,效用函数和生产函数的概念,可以引入经济系统,把经济稳定性与理性预期下的优化行为结合了起来。所谓最优化,意味着在很多可能性里面选出一个特殊的解。如果这个选择是唯一的,就有理由猜测均衡态应当是稳定的。微观经济学的生产和消费理论,金融理论中的有效市场假说和股价变动模型都是均衡理论的典型代表。

(2.2) 控制论和负反馈机制

对一般的控制系统而言,什么样的动力学机制,能导致稳定性呢?经典控制论的回答是负反馈机制。控制论的创始人是美国数学家维纳。他对控制问题的研究,从防空武器对飞机的追踪过程开始,进而受到神经生理学家对运动不协调病人观察的启发(Wiener 1948)。维纳从信息处理的角度,给了稳定性起源一个非常简单的答案:稳定性的机制在于负反馈。

举例来说,我们设定一个空调系统的室温为25℃。高于25℃给一个信号,让其下降,低于25℃,给出一个信号让其升温。负反馈的控制信号与原信号增量的符号相反。控制论的负反馈机制是均衡经济学的基本思想。经济控制论是工程师们把工程控制论,移植到经济学中产生出来的来的。不少著名的经济控制论专家是学电机工程出身的。

和控制论平行发展的是美国工程师申农建立的信息论 (Shannon 1948, Shannon and Weaver 1963)。信息熵是对信息定量的测量,它借用了平衡态热力学中熵的概念。熵是一个无序的量度。信息熵实质上是一个无知的量度。信息量的多少,取决于可能的状态数目。比如猜一个答案,如只有一种可能,你的猜测,事实上没有增加任何信息,信息熵为零。如果有二个可能的状态,你知道各自的概率不一样,信息就多一点。可以用这个方法来求对各种可能性加权的平均猜测。但是信息熵所测量的并不是我们的知识,而是我们的无知。比如说投资者在不知道结果是赔是赚的前提下,我们就假设输赢可能发生的概率相等,这恰是最无知的情形,而此时信息熵最大。目前我们还缺乏如何描写有层级结构的知识,这对下一代的信息论将是一个挑战。

应当指出,古典力学和古典统计力学的方法在控制论和信息论的发展过程中,起了重要作用。对任何动力学系统,我们可以用决定论的数学方法,也可以用概率论的数学方法去描写。原则上说,假如我们知道所有的独立变量,以及它们所有的高阶导数、或系统偏离其平均值的高阶矩,这个系统在数学上可以唯一确定。这在实际上不可行。

科学研究方法的核心问题是如何简化系统的数学描写,数学上说就是如何降低刻划对象的维数而不失去经验规律的主要特征。牛顿力学发现,对满足经典力学要求的机械系统,二阶导数就够了。相应地,对能量守恒的保守系统,二阶矩的统计描写也足够了,亦即服从高斯分布的正态系统。物理学的这些近似得到了不少实验验证。但是经济学的近似几乎没有实验的基础,基本原因是经济系统不是保守系统。

计量经济学中一个基本假设是说所有经济学的变量都服从高斯分布,又称正则分布。系统的统计性质可以由一阶矩的平均值和二阶矩的方差唯一确定。穆特的理性预期假说就明确地提出,理性优化行为指导下的线性动力学行为由高斯分布刻画(Muth 1961)。在平衡态的条件下,一个用概率分布函数描写的动力学系统,其平均值可以由一个决定论的方程描写。经济学中一个常用的概念叫确定性等价(certainty equivalent),把涨落不定的统计量,例如回报率和利润率,用确定的平均数来作简化的描述。马克思讲价格围绕价值波动。金融理论讲股票价格的内在价值,前提也是平均值存在和有意义。我们将会看到,平均值的概念在非平衡态下,可能失去意义。价值在技术变革或社会变迁时期,是难以测量和估计的。

(2.3) 均衡经济学和扩散过程

平衡或均衡理论对经济现象的成功解释,可以归结于扩散和趋同这一类现象。比如在充分竞争下,价格变动应该是收敛的,差别应该越来越小,这本质上是一个扩散现象。新的技术发明,新的思想总是向外扩散。在孤立系统中,温度应该趋同,差别最终消失,这就是古典热力学第二定律的结论。如果这个理论是普遍真理,那么宇宙将要热寂,温差总要消失。一切结构最终都会瓦解,人都要死的。它意味着宇宙演化的终极是一个均匀化的无差别系统。

均衡经济学的核心问题是证明均衡解的存在性,唯一性和稳定性。最有名的例子是新古典微观经济学的阿罗一德布罗(Arrow-Debreu)模型。这是一个线性、无摩擦的理想经济系统。阿罗在数理经济学上一个漂亮的工作,是用拓扑学的不动点定理,来证明市场经济有内在的稳定性。宏观经济学中最有代表性的经济波动模型,出自第一个得诺贝尔经济学奖的挪威数学家,计量经济学的创始人弗里希。他用古典力学中的阻尼谐振子模型(damped oscillator) 来描写稳定的市场经济(Frisch 1933)。他假设任何外来的经济冲击都会导致衰减振荡,因为有摩擦力存在,经济波动的振幅会是越来越小。若如此,又怎样理解持续的经济波动呢?均衡经济学的解释是求之于外因:经济波动必须由外来的噪声驱动和维持。在计量经济学中占统治地位的霍维尔莫模型,把整个经济描写为噪声趋动的线性系统(Havelmoo 1944)。

计量经济学的噪声驱动理论对生物学家来说,是很奇怪的事情。大家知道,人的正常心脏跳动频率在每分钟六十跳到八十跳左右。如果说心脏跳动是环境里的噪声在那里驱动,生物还能维持心脏跳动的频率稳定吗?显然不可思议。(提出问题来思考)古典经济学的创始人马歇尔在他的名作“经济学原理”的序言中说过,经济学应当接近生物学而不是力学(Marshall 1920)。只因生物学难于用数学描写,才借用力学的比方,但经济学家头脑里应当有生物学的观念。

相信均衡理论的经济学家干脆不接受经济波动的事实。均衡经济学家以为,经济系统的理想状态应该是均衡的,没有波动的,没有结构的。看来,新古典经济学家的数学知识增加了,但经济学的直觉反而退步了。

[我在这里说点题外话。科学史上一个有趣的教训,理论僵化的往往不是祖师爷,而是教条化的后代弟子。牛顿不是牛顿主义者,马克思也说过他不是马克思主义者。读者学习科学,不要光想走捷径,只读二、三流弟子写的简化通俗的教科书,要尽可能多读大师的原作,才能学会研究的方法。]

均衡经济学七十年代达到顶峰,八十年代受到了挑战。下面我们会看到,新的社会实验,即三十年代西方经济的大萧条和八七年发生的股市崩溃等事件,动摇了人们对均衡经济理论的信心。注:(结果动摇原有的理论和信心,结果也可以归纳出理论和树立信心。)

【三.系统复杂性的初步探讨:从观察到猜想】

物理学家首先从生命现象的观察出发,对古典热力学的平衡态理论提出质疑。量子生物学对生命现象的物理机制提出卓有远见的猜想。突变论、协同论对复杂系统的行为描述进行了初步的探索。不同学科的发展为复杂系统研究的突破开辟了道路。

(3.1) 多样性问题的提出

对注意观察实际生活的理论家来说,有一系列的新问题可以促使他们超越均衡观的局限,注意到世界多样性的起源。第一个问题是生命的起源。如果世界是稳定和均衡的话,生命就不可能产生和演化。请注意:生命演化的前提还不是达尔文的物种演化,而是生命发生前化学结构,从无到有的演化。达尔文理论的前提是必须先有遗传性能的大分子,才能有后面的物种演化。最开始宇宙是一个均匀的气体或称为“原始汤”的液态,它怎么会演化产生出非均匀的分子结构,并从低分子演变到高分子结构呢?

第二个问题是关于宇宙的起源。现在最时髦的宇宙学是宇宙大爆炸理论,那么爆炸以前呢?除了真空什么也没有。这也是一个非常有争议的理论。

科学史上一些理论的荒谬是从某个成功的理论中无限外推而产生的。任何理论的有效都有一个界限,找到这个极限就可以做一重大的改良。爱因斯坦的广义相对论在解释行星、恒星运动时非常成功。爱因斯坦的基本想法就是把一个生命的、动态的、多样化的世界简化成一个静态、几何化的世界。经济学中的均衡观也是一个类似的几何观念,例如微观经济学中的描写帕累托最优(Pareto Optimium)的艾奇沃思盒(Edgeworth Box),就是均衡经济的静态几何观的典型表现。但是,几何化的办法在解释生命社会现象丙不成功。

第三个不能回答的是李约瑟问题,涉及到经济学的范围,即近代科学和工业的起源,资本主义的起源,为什么会在西欧而不是中国,不是阿拉伯或印度?

第四个问题是市场经济持续波动的原因。这一问题在经济理论上的严重性是在70年代以后才被人们认识的。三十年代大萧条促使凯恩斯挑战古典经济学的信念,所谓看不见的手会自动达到市场稳定与充分就业,这个信念已经动摇。但凯恩斯的信徒们发展了经济控制论,把工程控制搬到经济学中。在60年代美国经济鼎盛期,他们一度认为美国的经济波动已经消灭,经济周期(business cycles)这个概念已过时。他们信心十足地认为政府可以对宏观经济进行“微调”,好象政府有经济控制的旋钮一样。但很快石油冲击和越战发生,通胀来了,黄金与美元被迫脱钩,这些都使经济学家重新认识到经济波动的持续存在。

中国的文化大革命中,毛泽东关于中国运动七、八年就来一次的说法,也使社会主义经济学家认识到计划经济也无法避免经济波动。所以70年代是一个很大的转折点。光给市场经济唱赞歌,信仰市场经济的稳定性到七十年代已经不够了。人们要问为什么经济发展会有波动和不稳定。不稳定性的来源一定和控制论研究的主题——负反馈机制--相反的问题有关。

历史上有远见的学者,可能会把问题提出得非常早,但能否受到社会的普遍关注还有待历史的进程。正如库恩在“科学革命的结构”中所言,科学规范的演变不光是科学家内部逻辑演变的结果,而且和社会思潮变迁的推动有很大关系(Kuhn 1962)。

假如你相信新事物的产生满足大数定律,资本主义产生的必然性是普遍有效的话,那么科学革命应该发生过很多次,而生命的产生也有很多次了。尽管不少技术的发明有重复性现象,然而,很多事实表明,生命与科学的产生是一种非常偶然的现象。

以上几个问题都涉及怎么解释从无序到有序,从比较简单的到比较复杂的东西。古典科学的理论,包括优化理论、线性稳定性理论不能回答这些问题。

(3.2) 薛定锷和量子生物学

在复杂系统研究中,一个重要的先驱者是奥地利物理学家薛定锷,他是量子力学的创始人之一。在其“生命是什么”的著名讲演中,他认为古典力学和平衡态热力学的理论是难以理解生命起源的。他尝试用量子现象来研究生命(Schrodinger 1944)。他提出了三个非常重要的猜想,所有这三个猜想都对后来的科学发展起到了非常重要的贡献,虽然当时这些猜想只是定性的,没有给出任何定量的方程。

他的第一个猜想是,演化的基础必须是亚稳态。假如在平面上放一个球,那是不稳定的,就好比游牧民族;如果把球放进一个无穷高的位垒,它一定是非常稳定的,状态很难变化。

中国的封建社会这么长,就是位势太高了。如果你既要解释这个系统的稳定性又要解释这个系统的可变性,描写的办法是在这二者之间找一个中间态,它的位垒是有限高的。这样,对一个多稳态的系统,外面有一个干扰,例如宇宙线的打击,或者其他文明的冲击,就会使粒子状态发生跃迁,从能量较低的亚稳态跃迁到能量较高的亚稳态。

他的第二个猜想是,生命秩序的结构形态,应当是非周期性的晶体。如果是晶体点阵就太规则了,静态的结构很难变化;象气体那样完全没有规则也不行。如果要有生命,只能是在晶体和气体之间的中间结构,他称作非均匀、非周期性的晶体。薛定锷的学生们在生物实验中研究了蛋白质大分子的结构,终于发现遗传密码,其研究思想来自于薛定锷。

薛定锷的第三个猜想是,结构演化的度量应当是负熵。如果信息熵测量的不是秩序,而是无序的程度,那么秩序的测量就应该倒过来,是负熵。如果生命的演化是从无序到有序,从低级到高级,那么就标志着负熵的增加,所以负熵是秩序,熵是无序。

(3.3) 突变论的提出和争议

前面所说的是一些理想实验或定性猜测,没有发展成系统的数学方法。1963年代法国数学家汤姆(Thom)提出了突变论(catastrophe theory),开始时轰动了很多领域。突变论研究的是保守系统,理论上可以有一个势函数。不同模型的变量数不同,可能发生突变的类型也就不同。可以从拓朴学上对突变类型加以分类。最熟知的突变例子就是物理学中的相变。突变论迅速被用于许多先前被认为无法用数学描述的现象:例如一只狗为什么会突然咬人或逃走,囚犯为什么会突然暴动或退缩,股票为什么会突然暴涨或暴跌等等,都有人设想出某种势函数来加以描写(Zeeman 1977)。但这股风潮受到前苏联著名数学家阿诺尔德(Arnold)的严厉批评。阿诺尔德指责汤姆没有发现任何新的问题,只是将已知的例子(例如相变)贴上了数学名词的新标鉴,而诸如心理学、股市运动之类新的势函数的存在,理论上根本无从说明。从经验科学的标准而言,突变论是一个失败而非成功的例子。

(3.4) 集合行为和协同学

第三个理论在物理学界很有影响,但在生命科学和社会科学中没有多少应用,这就是德国物理学家哈肯提出的(Haken 1977)的协同学(Synergetics)。

复杂系统从数学而言是多体问题,从物理学角度来说研究的是集合行为。这么多变量数学上怎么处理?经济学界有一个著名的奥地利学派,他们根本就不相信一个社会经济系统可以用数学来描写。他们认为经济系统太复杂了。描写一个人应该有多少变量?人的自由意志也许该有无穷多个变量。这样一来,社会研究便只能讲历史故事,没什么科学模型可做了。

复杂系统研究的主要问题是怎样把一个无穷多变量的系统简化成一个相对简单的低维数系统,从而有助于定量研究复杂系统的规律。协同学的核心是所谓奴役原理(slave principle)。哈肯提议把变量分类:一部分是慢变量,一部分是快变量,在相对短的时间尺度内假设慢变量不起变化,可以视为常数,这就大大简化了系统的描述。这一方法在物理学中有广泛的应用,通常称作“绝热近似法”。但对经济学来说奴役原理很难应用,因为经济学中很多变量的变化率是同一个量级的。物理学可以通过可控制实验来减少变量数,但社会问题很难做可控制的实验。哈肯本人想到的经济中的慢变量是语言和文化,这在经济学模型中很少给以考虑(Haken 1998)。所以协同学在经济学中影响很小。

【四.复杂系统科学的兴起:非线性、非平衡、和非稳态过程的研究】

现在我们来讨论复杂科学在近二十年间的巨大突破。决定论混沌(deterministic chaos或简称为chaos)理论、和非平衡统计物理的发展,为自组织系统的理论奠定了坚实的基础。非线性、非平衡、和非稳态过程的研究为复杂系统行为的定性与定量研究打开了广阔的天地。混沌理论的数学基础是非线性动力学。开始阶段只是一些计算数学的模拟试验,并不和实验观察相联。复杂系统真正有意义的突破不但从大量经验观察中发现混沌现象的普遍存在,而且发现非线性机制的若干普遍特点,使人们大大加深对现实世界的了解。

(4.1) 庞加勒(Poincare)和不可积问题

如果你单单讨论稳定性的话,事实上是在将复杂现象简单化为古典力学和平衡态热力学中已经了解的简单现象。你研究的对象虽是复杂系统,你思维的方法仍停止在简单系统。所以深入研究复杂性,是从稳定性问题的反面开始--探讨系统不稳定性的机制。

概括地说,建造经典力学的大厦只有二种漂亮的砖块。一块是伽理略开始研究的钟摆,数学上称作简谐振荡(harmonic oscillator);另一块是爱因斯坦研究过的布朗运动(Brownian motion),数学上又称随机游走模型(random walk model),工程上叫做白噪声 (white noise)。古典物理学家认为这二个砖块已经足够漂亮了,只要把砖块象积木一般搭起来,就可以构成漂亮的大厦。任何一个复杂系统,可以用简单的线性系统作足够好的近似。

这个信条很快被打破了。混沌(deterministic chaos)现象的发现,促使人们寻找这两个极端之间的中间模型。庞加勒(Poincare)在研究天体力学时发现,三体问题不可积(郝柏林1990),没办法用线性扰动理论处理。

我们用线性理论能够解释的只是二体问题,经济学中有解析解的也是二体问题,因为二体问题可以用一个数学变换化为一体问题。比如地球围绕太阳转的行星运动,只要以质心作座标系作一个坐标变换,就变成了一个一体问题。行星运动的椭圆轨道在沿轨道平面上的纵轴上投影,就化成钟摆的一维运动。微观经济学中的艾奇沃思盒(Edgeword box),国际贸易中的比较优势理论,都是依据二体模型所作的推论,对三体问题未必有效。

三体加进来之后,这个系统有没有解析解,是否稳定呢?这个问题很深刻,关系到多体问题的可积性问题。如果这个系统是可积的,可分离变量,那一定有解析解。多数人猜测三体问题肯定有解析解,也可以用简单系统的叠加来近似,结果他们猜错了。

后面我们将看到,不可积性的发现是混沌(chaos)研究的起点。计量经济学家所喜欢的回归分析,其理论基础也在于系统的可积性。不可积性的普遍存在将动摇古典计量经济学的理论基础。

(4.2) 非线性机制和混沌现象的研究

和突变论几乎同时起步,但迟迟才被科学界承认的研究是混沌现象的发现。也在1963年,麻省理工学院的洛伦茨在研究气象预报方程的数值解时发现了混沌现象(Edward Lorenz 1963)。流体力学的浅水波方程可简化为非线性的常微分方程组。大家知道,牛顿力学方程是线性决定论的常微分方程组,只要给定初始条件,系统的轨道完全能够被精确预言。但洛伦茨用计算机处理,发现如果是非线性系统的话,初始条件只要变动十亿分之一,这种以往可以忽略的扰动,会被不断放大,使得在一定时间尺度之外的系统轨道完全不可预测,这说明系统非常的不稳定。这种对初始条件高度敏感的决定论的不稳定现象,后来在生物学、化学中也相继发现,被数学物理学家命名为决定性的混沌(deterministic chaos),简称为混沌。

应当指出,混沌这一说法很易引起误解。最先取名的数学物理学家过分强调混沌现象中无规则的一面而忽略其中有新规则的一面。应当强调的是,混沌不是无序而是更高的秩序。人们一说混沌就以为是灾难临头,就是动乱暴发,其实更确切的说法应当是非线性振荡(nonlinear oscillator),我们在经济波动的研究中主张采用复杂周期(complex cycles)或不完美周期(imperfect cycles)的提法。比如说心跳便不是钟摆,心跳可视为一个非周期的振荡,频率有一个很窄的摆动,这种运动和钟摆相比是一种更高级的秩序。

这里有一个很有趣的事情,三似乎是复杂系统的一个关节点。数学上我们知道,就常微分方程系统而言,混沌现象产生的必要条件是系统的维数必须大于或等于三。搞天体力学的人发现,任意放三个小行星在系统里任它们旋转,最后的稳定形态一定是只剩下二个行星的组合,第三者最终被抛出去(Szebehely 199?)。社会心理学家注意到,组织形态和组织大小有关,二元组和三元组的行为有质的不同(Hare 1976)。比如让学生们在教室里自由讨论,二个人会讨论得很亲密,三个人就会产生权力斗争,增加到五个以上就可能分成二个子系统,再加人会产生更复杂的系统结构。研究通讯和组织理论的社会学家观察到,一个复杂系统大到一定程度以后,便会分解成几个相对简单的子系统。

由此可见,企业的组织形态和劳动分工是一个在实验观察和系统数学上都很有趣的问题,而对这个问题的探讨有很多不同的途径。不同学科不约而同的观察使人们意识到复杂性问题的普遍性。比如说,二和三的差别可能是简单系统和复杂系统之间的第一个关节点。

(4.3) 非平衡演化的研究

最有趣的事情是意识到非均衡的存在,非线性本身带来一个多稳态。如果只有一个稳态,则可以作优化;若有多种可能的状态,势函数有好几个凹坑或凸包,在几个点跳来跳去,这就是一个多稳态了。但结构为什么会演化这个问题单单引进多稳态是不足以解答的。这个问题的启示从负熵开始,物理学家开始意识到热力学第二定律不是普遍合理的。普里高津对非平衡态热力学有非常重要的贡献,他在“演化的热力学”一文中将所有系统分成三类:孤立系统、封闭系统、和开放系统(Prigogine et al. 1973)。三者的演化方式完全不同。

如果是一个孤立系统,热力学第二定律成立。时间箭头只有一个:人总要死的,差别总会消失,演化的规律一定是从有序到无序。放一杯水,温差最后一定消失到和周围环境温度一样,但这个规律只对孤立系统成立。

一个封闭系统可以交换能量,在经济学上就是可以买卖,但要素与人口不能流动,信息也不能流动,那是一种什么结构呢?那是一个静态结构。最简单的静态结构是晶体。放一杯盐水让其降温,开始时看不见结构,后来小盐块结晶出来了。这种静态结构能否解释经济和生命系统呢?严格说来不能,近似还可以。在城市研究、开放经济中就会用到晶体模型。但真正研究生命演化这类问题必须在开放系统中处理。开放系统的定义就是同时存在能量流、信息流、物质流,三者缺一不可。对人体来说就是需要消耗与补充能量流、物质流和信息流,光有存量不行。这种结构就叫耗散结构,因为这种结构的维持要不断消耗物质、能量和信息。

中国人最早的演化观是退化论。孔子“今不如昔”的观念颇与古典热力学的孤立系统理论相近,其原因可能和中国农耕民族对黄河流域的生态破坏有关。佛教的传入把循环论的演化观带进中国。进化论向上的时间箭头的概念是犹太人的贡献。犹太人相信未来比现在好,演化是进步,先进要战胜落后。这是一种单向或线性的时间箭头。

复杂系统的演化观没有这么绝对,因为非线性、非平衡将多向性与多样性引入演化。演化的结果,可能变好,也可能变坏。如果你认为演化只有一种可能性,在计划经济中领导会考虑一切,民间的主动性就没有了;如果在市场经济中看不见的手会自动达到最优,那么游戏规则的制定、产业政策的协调也不用做了。这都不符合当代各国的历史经验。现在我们发现历史演化路径的选择面临的不是均衡理论预期的平原,而是山峦起伏的风景(landscape)。不可能有唯一优化的捷径,山与山、谷与谷之间未必有路可通。你今天认为这条道路是优越的,到明天别人就可能发现另有新径了。

值得注意的是,斯大林的历史观是单线的,马克思的历史观却是多线的。马克思把历史演化看成是一个台阶式过程,从原始社会、奴隶社会、封建社会、到资本主义社会。马克思对亚细亚生产方式的讨论明确表达了亚洲和西欧历史演化的不同。

我们来考察新古典经济理论属于什么样的热力学系统?历史上,一般均衡理论正出自古典热力学的影响(Mirowski 1989)。新古典经济学的代表者模型属于孤立系统的一体模型,包括弗里德曼(Friedman)的货币中性的岛屿经济模型,和卢卡斯(Lucas)的理性预期理论。科斯(Coase)的交易成本说是个二体模型。古典和新古典经济学的主要特点是强调竞争过程的趋同性和市场经济自身的稳定性,却忽视结构的多样性、市场波动的不稳定性和演化的多向性。

(4.4) 非稳态过程的描写

如果你承认有非线性,还有非均衡,那么一定会有时间相关的非稳态。稳态通常是描述随机过程的,我们现在学的时间序列的数学分析,数理统计教的相关分析,其背后的假设都是一种稳态系统,如果是非稳态系统就不能操作了。

爱因斯坦相对论的一个非常重要的贡献,就是发现时空不可分割,测量的同时性是有条件的。我们研究经济波动时发现,测量时间和测量频率不能同时测准,必须构造一个更高维的空间:时间-频率空间来研究时间相关的频率演变现象,就象医生研究病史一样研究频率的演化。物理学家伽宝建议了一个时间-频率的二维表象,对我们做经济学诊断有很大用处(Gabor 1946)。

传统的经济波动理论用机械钟(谐振子模型)或白噪声(稳态随机过程)来描写经济波动,把持续的经济波动归之于外来噪声冲击的结果,否定经济内在的波动机制。因而他们不能处理结构演化引起的经济运动。我们采用时间相关的非稳态时间序列分析方法,就会发现经济系统象生命有机体一样,有自己的生命节律。经济波动和经济系统的新陈代谢机制是不可分割的(Chen 1996)。

(4.5) 稳定与复杂、安全与机会的消长(trade-off)关系

前面我们讨论了稳定性和多样性。现在要问,这二者的关系如何?这一问题最早是由生物学家而不是经济学家提出来的。但这问题对经济学家十分重要。中国经济改革面临的一个首要问题,就是稳定与发展的关系。

东欧和前苏联推行的休克疗法把稳定放在第一位,以为只要实现市场稳定,经济就会增长,并自动实现资源分配的最优,结果经历了战后最严重的经济萧条。东欧经济下降过程中,货币物价很难稳定,最后虽然稳定下来,但代价高昂。中国前十几年的改革把发展放在第一位,和休克疗法的指导思想相反。结果中国人取得成功。我们发现,在经济增长过程中的价格改革和结构调整较易进行。相比之下,中国目前经济失序的问题在于中国金融改革的滞后,中国金融改革滞后的一个原因是在指导思想上害怕金融秩序失稳。其实越是害怕失稳问题就越多。

由此可见,稳定和发展是一个非常重要的问题。到底二者是什么关系呢?理论生物学的猜测是一个系统越复杂就应该越稳定。这想法是从达尔文理论的逻辑来的。达尔文理论有一个著名论断叫做适者生存,而且是最适者生存。虽然达尔文没有明确说最适者便是优者,但他最适者生存这个说法,可以自然推广为生存者即为适者,最适者定为优者。优者是什么?

从控制论的观点看,优者就是稳定。假如你综合达尔文的进化论和控制论,你一定会猜测系统在从简单到复杂的演化过程中,应该是越复杂的系统越稳定。但是控制论学者作的大量计算机模拟,得到的结果和原先的猜测相反,他们发现系统越大越不稳定(Gardner and Ashby 1970)。这一结果使生物学界大为哗然。理论物理出身的理论生物学家梅依做了一个很重要的改进(May 1974),设计了一个非线性系统,结果还是越复杂的系统越不稳定。让理论生物学家大伤脑筋。

我们从系统复杂性问题的反思出发,承认数学模拟结果的天然合理性:因为生物和社会的大量观察表明:增加复杂性会降低稳定性(Chen 1987)。科学匠和科学家在方法上最大的一个差别在有无创造性的思维。科学匠不问问题便在那里忙着算,你算小数点后面二位,我算到八位,就自以为有成就了。但是创造性思维的科学大家偏要问基本的问题。而科学的基本问题往往是从简单的观察中产生,而不是从前人的思维中去获得的。微观经济学的阿罗一德布罗模型数学上那么简单漂亮,但股票市场一崩溃,人们对它的信念就动摇了。单有稳定性不能解释经济波动和股市崩溃。所以生物学家和经济学家都要问一个共同的的问题:系统到底越复杂越稳定,还是越复杂越不稳定?

科学史上有一个教训,如果人们前赴后继的探索总是得到一个否定的答案,是不是应当承认现实,把结论倒过来:原先认为不对的是正常的,原先认为应该对的反是不正常的。这种例子很多,永动机不可能,于是产生了热力学第二定律。光速传播无限的不可能,产生了狭义相对论。我们接手这个问题时,一个自然的思路是倒过来,越复杂的系统只能是越不稳定。我们联想许多生活中的常识更发现这一结论必然是对的。例如,简单生物的再生能力非常强,蚯蚓一截二还可再生为二条蚯蚓,一个高等动物一劈二就完了。再如纽约一百十几层的贸易大楼炸一个炸弹或断一下电,整个楼就乱套了,日军飞机在中国农村扔几颗炸弹没什么了不起。这是中国的游击战能在农村打败机械化的日军在系统学中的道理。所以复杂性和稳定性的矛盾颇象是鱼和熊掌不可兼得的关系,两者此消彼长,不可兼得。

【五.均衡经济学面临的局限和挑战】

均衡经济学在引入数理方法来描写经济社会有开创性的贡献。她架起数理科学与人文科学之间的桥梁。均衡经济学对市场稳定性的机制,例如价格竞争和技术传播的收敛趋势,作了有用的研究。然而,本质上均衡方法只对封闭系统有效。均衡经济学的许多描述,例如微观经济学的岛屿经济,产权经济学的二人交易,可以近似描写前资本主义的物物交换市场。但开放经济的现代市场是一个远离平衡的复杂经济系统。本质是静态的均衡经济学模型在定量描写演化经济的变动时,就面临难以克服的困难。

均衡经济学的理想世界是一个没有差别、没有结构、没有记忆、没有历史、也没有变化的世界。经济结构的产生是由于摩擦力,例如交易成本或税收,而非内生的非线性非均衡机制。和生物学的演化观相比,均衡经济学的宇宙观是一个典型的牛顿力学的机械观。1989年柏林墙拆除以后,有一个美籍日本人福山(Fukuyama)预言说历史将要终结了,世界各国以后都将进入一个无聊的无差别的资本主义世界。这是典型的均衡思维。他不承认冷战后的大趋势是全世界多样化的发展。

林毅夫对中国经济学家寄予厚望,希望中国人有可能在二十一世纪的诺贝尔经济学奖。经济学研究能否有所突破,关键是你能否把现实中观察到的问题和经济学的基本问题联起来,证明它或否定它。发现问题比解决问题更困难。

科学史上,把握科学突破的关键问题需要远见和勇气。当二十时纪来临时,曾经有两位大科学家对当时科学的问题和未来发展的方向,作了大胆的预言。一位是发现热力学第二定律的英国物理学家开尔芬。他乐观地宣布经典物理学的大厦已经建成,然而天空有两朵乌云。五年之后,这两朵乌云变成相对论和量子力学的两股风暴。还有一位是德国大数学家希尔伯特,他列出.. 23个数学上未解决的问题,成为许多青年数学家努力的目标。

从此之后,自然科学界每过一个时期,都会用科学界的集体努力,对当时科学的前沿作一调查,以指导科技政策。如今二十一世纪即将来临,经济学的前景如何呢?1991年英国皇家经济学会借经济学杂志(Economic Journal)一百周年之机,出过一期专刊,回顾过去百年经济学的进展,预测经济学下一个百年可能的发展。十几位有影响的经济学家发表了自己的预测,其中不乏真知灼见,建议同学们一读。可惜里面的从传统理论出发的个人感觉太多,从新角度明确提出的研究问题太少。

苏联人造卫星发在美国之先,曾在美国引起一次科技政策的大辩论,刺激美国进行了一次彻底的教育改革。加州大学出过一套非常好的普通物理改革教材,鼓励学生发现问题、思考问题。比如教电学的库仑定律,两个电荷之间的作用力和它们的距离平方成反比。传统的教科书陈述这一实验事实就完了,而这本改革教材上来先对库仑定律是否成立打了一个问号,然后介绍科学家检验非平方反比律是否成立的实验,给出库仑定律成立的空间尺度( Purcell 1965)。这是非常好的教育方法。假如我们想问类似的问题:经济学的规律成立到什么程度?

几乎看不到经济学的标准教科书有定量的讨论。举例来说,公司金融理论说股票价格的基本面应当由未来收入流的贴现值决定,利率升高导致机会成本升高和现值下降。问题是对未来收入流的预期时间尺度到底该多长?

中长期投资者也许会看5年,短期投机家只顾几个月。对美国股市的历史数据分析发现,如果以5年为期来计算平均的股份收入流,只能解释股票现值的.. 20%左右;如果以.. 25年来计,也只能大致解释到.. 75%。不同经济部门股票走势的差别更大:若以.. 8年为期计算,烟草行业的折扣收入流能解释股票现值的.. 44%,运动器材只能解释.. 19%,皮肤保健品几乎是.. 0%,在高科技领域的比例竟为-25%看好,股价仍会上涨。因为高科技领域注重战略决策,初始几年的投资可能根本没有回报(Copeland, Koller and Murrin 1994)。均衡理论的误差可见一般。

所以我们对西方主流经济学的介绍,要取科学客观的态度。从70年代开始,主流经济学中几乎所有的领域都陆续发现理论不能解释的经验困惑。微观经济学是高度公理化和自洽的理论体系,其理论基础是仿效古典力学的哈密顿形式体系-理性假设和优化原理。但在实践上,理论和观察存在很大的差距,越来越多的心理学和实验经济学的实验,挑战微观经济学的基本假设和适用范围。

宏观经济学的困难在如何从演化的经济中寻找稳定的规律。计量经济学的回归分析方法,在处理复杂经济系统上面临深刻的困难。这些疑难从方法论而言,主流经济学的方法基于四个基本假设:即线性、均衡、稳态、和单体问题(二体问题数学上可以化为单体问题)可以用本文开始的说法来概括,说穿了就是这样四个方面的问题:非线性、非均衡、非稳态。和多体问题(亦即集合行为)。从经济学理论和实践的冲突来观察,则表现在微观经济学、宏观经济学、和计量经济学的各个方面,我们略举若干例子,给大家思考。

(5.1) 非线性效用函数和多稳态机制

微观经济学中的效用函数假设人的欲望无穷,消费越多越好。但世界上没有一样东西是越多越好,吃得太少或太多都要得病,住房太大不但在经济萧条时面临大幅贬值的风险,而且在心理上给人造成空虚和恐惧感。

实际的效用应该是数量的非线性关系,适度区域和历史条件有关。许多貌似“无理性”的经济行为,在一定的生态文化约束下,是十分合理的选择。这就必须修改微观经济学的优化理论。

我们讨论行为经济学问题。凯恩斯一个巨大的贡献就是把心理学引到经济学中来。现在的心理学可以做实验。关于人的经济选择是否是理性的,在八十年代心理学家和经济学家有一个大辨论 (Hogarth and Reder 1988)。最开始发起挑战的是诺贝尔经济学奖获得者心理学家西蒙,他认为人的理性是有限的,人脑不可能处理非常大的信息(Simon 1957)。行为经济学家的实验发现了固锚(Anchor)效应(Kahneman, Slovic and Tversky 1982)。

人的思维不是一个理性选择,把所有选择平等衡量。人们选择的偏向象一个船锚那样固定:船在海上漂荡,总围着那个锚的附近转,相对预定的目标调整。卢卡斯辩解说,理性选择指最后的结果可以用优化模型来比拟。但假如选择的对象是三个而非两个,优化理论就难以给出和观察一致的结果。

均衡金融理论最漂亮的一步是资产定价理论。均衡定义为无套利机会存在。Ross进一步证明,无套利机会等价于线性价格关系(Ross 1976)。这就指出均衡理论的限制。假如利率对所有人都是一样的,而且是一个常数,不随时间改变,那么均衡价格就可以存在。在中国,利率表面上对所有人相同,因为官方利率没有市场化。实际上灰色利率因人而异,塞红包吃回扣,套利机会鼓励了腐败行为。西方金融市场即使是公开竞争,利率也不会一样。你的信誉差、负债率高,风险大,你的利率就要比别人高。另外,规模效应可以降低出售者的市场风险,所以批发商愿意对大量的买主打扣折。凡此种种都是非线性价格。如果是线性定价,你就有均衡解。如果是非线性定价,就没有均衡解。

与此相关的是公司金融理论中的MM定理。该定理断言在完全竞争条件下,公司的资产价值和债务结构无关,也和公司的红利政策无关。这和市场经验相矛盾。原因是MM定理的核心假设是线性利率的存在保证无套利机会。这对非稳态经济波动下的金融市场并不成立。

(5.2) 企业层次的规模递增和有限竞争

劳动分工、规模递增的现象直接和优化概念相冲突。要有优化解就必须是凸函数,凸性被破坏情况下又会怎样,其实是多均衡的问题。英国皇家经济学会纪念经济学杂志一百周年的专刊中,有一篇文章专门讨论对现在正统的Von Neumann的预期效用函数的修改方案,讲到非凸性、非线性、非传递性的预期效用函数的种种可能方案(Fisburn 1991)。

微观经济学保证优化解存在的一个要求是均衡经济不允许规模递增。但规模递增是劳动分工发展的一个重要因素。福特引进流水线大规模生产汽车,证明企业层次的规模递增是不可否认的经济效应。目前经济学妥协的结果是只承认规模经济对产业和国家的层次存在,而继续保留企业层次的优化原理。

规模递增首先在国际经济学中得到承认。克鲁格曼观察到国际贸易中的“反常现象”:发达国家之间的贸易量远远超过发达与不发达国家之间,这不符合古典经济学的比较优势理论。克鲁格曼用规模经济和垄断竞争作了一个很好的解释(Krugman 1979)。为什么日本车出口美国呢?因为汽车产业要大量投资,规模越大成本越低,竞争的目标不是追求最大的利润,而是追求最大的市场份额。引进规模经济到国际贸易中来首先就打破了一个概念,原来认为竞争只有两种类型:要么垄断要么完全竞争,事实上完全竞争是不可能的,垄断竞争也是不现实的。应该进一步研究有限竞争。市场、自然资源的占有是有限的,对质量、安全的标准也要求对市场的进入有所限制。所以,合理的竞争行为应当是在完全竞争与垄断竞争之间的有限竞争或适度竞争。

规模递增也被引入内生的增长理论。索洛的新古典增长理论预言所有国家的增长率有收敛的趋势(Solow 1970)。卢卡斯注意到各国经济增长率的发散性,然而又不愿放弃优化原理,只能承认规模递增对整个国家可以成立,而在微观来说对企业没有意义,这样以折衷的办法保持优化原理(Lucas 1988)。他们的思想方法颇象二十世纪初的德国物理学家普朗克,他发现了量子现象,却拼命想让它在古典力学的框架内来加以解释。

(5.3) 信息模糊和不确定风险

信息不对称在微观经济学是一个很有名的问题(Akerlof 1970)。有趣的是,斯蒂格勒等人给出了一个证明:假如忽略信息成本的话根本就没有交易,阿罗一德布罗模型描写的不是市场经济,而是自给自足经济(Autarky) (Grossman and Stiglitz 1980)。

信息问题在金融业最为严重。信息不对称导致道德风险(moral hazard)和反向选择(adverse selection)。西方经济学家常常把不发达问题归之于发展中国家缺乏金融市场。但是就在发达国家,银行也是嫌贪爱富,只愿意贷款给,把钱借给最不需要的有钱人,而不愿意贷款给穷人,因为后者没有财产可担保。与此相联的现象就是对利率来说银行有一个信用配给现象(credit rationing)。商品卖方总是卖给出价最高的人,但借钱银行并不敢借给出利息最高的人,因为借钱者可能根本不想还。这些借款的人他知道自己不会还钱,而银行不知道,所以有一个信息不对称问题。这个问题在中国非常严重,中国经济现在增长很快,可是信用瓦解,经济秩序混乱,一个很大的问题就是信息不对称。中国没有一个信用制度,没有一个经济档案制度,今天骗这个明天骗那个。在信息缺乏情况下的竞争是一个反向淘汰机制,赚钱的人可能不守法,守法的被坑蒙拐骗。

但是微观经济学的信息成本理论引进信息成本的概念,并不足以讨论信息经济学中不确定性引起的不稳定性。信息不对称是一个静态的观点。其实很少有一开始就是不想还钱的坏人;如果你这种制度安排下搞一个拔改贷,搞得原来好的企业也不能生存的话,狗急也要跳墙,本来不违法的逼他们违法。他们的行为是守法还是违法,是一个动态的问题,演化的问题。美国八十年代搞的金融解规,因为放松了金融监管,结果出现储蓄贷款银行的严重危机(S&L debacle)。

风险测量的基础是方差。如果服从高斯分布,平均值是有意义的,方差是有限的,这种情况下一定会得到均衡解。奈特和凯恩斯指出不可预测的不确定性的影响(Knight 1921, Keynes 1925)。奈特明确区分考虑统计确定的风险(risk),和统计意义上不可预测的不确定性(uncertainty)。微观经济学讨论的不确定下的优化行为(optimization under uncertainty),其实只考虑统计确定的风险,用的是平均值和方差不变的高斯分布。目前没有有效的方法测量奈特意义下非不可预测的不确定性所引起的信息模糊。这涉及到在微观经济模型中对宏观经济波动影响的考虑。

在金融理论中做得最漂亮的是期权理论。前面指出一个复杂系统需要多个变量,在期权理论中未定参量只有一个-股价变动的方差。数理经济学理论真正对操作发生影响的是期权 (Black and Scholes 1973)。他能够把金融中很多的变量最后压缩到大部分可以从观察中定量,比如股票价格,相应的风险利率,交易的时间间隔等,从而可以计算期权价格。但市场交易中观察到的分布不是这样,方差不是常数,股价变动率(volatility smile)随时间“微笑”(Rubinstein 1985)。这是目前金融理论中的一个重大问题,需要对金融的非线性、非均衡、非稳态现象作深入研究。

(5.4) 多体问题下规则相关的市场行为

均衡经济学的基本框架是单体问题,不考虑社会群体的集合效应。数学上二体问题可以化为单体问题。所以微观经济学的基本模型,只限于二体问题。三体问题的结果就可能大不一样。典型的例子包括国际贸易理论只讨论两个国家、两种货物的交易。宏观经济学的微观模型用一个代表者试图描写行为相同的经济人组成的宏观行为。这些模型在解释非均匀结构和非一致行为时就面临困难。多体问题可能引起的重大困难应当属于制度经济学的领域,因为制度的产生和演化本质上是社会而非个人行为。近年来影响颇大的产权经济学,其理论基础是科斯的二人讲价模型 (Coase 1988)。

交易成本理论为制度经济学奠定了均衡理论的经济学基础。产权经济学断言,市场看不见的手会自动选择最佳的制度安排。产权经济学认为理想的市场经济是没有摩擦力的,企业组织的起源是为了降低摩擦力。科斯定理的猜想是,如果你观察到的制度安排是和你的初始条件,历史条件没有关系,就一定会有一个均衡解。原先的交易成本理论是在对市场经济的观察中提出来的。张五常把它推广到前资本主义世界中,虽然前资本主义没有完全竞争的市场条件。比如租佃率这样的制度安排应该和初始条件没有关系。张五常做了一个大胆推广,如果你观察到的地租率都是.. 50%,那地租率就是收敛的,均衡的,所以全世界的均衡租率都应该一样。他推论说台湾战后的减租和土地改革是降低效率的,因为破坏了均衡(Cheung 1969)。均衡论忽略结构和演化的倾向可见一斑。

产权的均衡理论只说了一面之理。奥地利学派一直强调市场经济的生产过程。很多新技术的发展,并非是市场上已有零部件的组装。交易成本只是企业家考虑的一个战术方面。战略上,尤其高科技的新企业,意在由不同专长的合作,会创造以前不能想象的合作潜力。劳动分工的整体趋势是增加复杂性,从而增加能量的耗散,目的是在整体上创造负熵,创造价值,不只是在局部上降低成本。各国制度的极大差异表明,制度演化并无收敛趋势(Olson 1996)。制度安排和竞争结局一样,是和历史的路径相关(path-dependent)的。实验经济学的研究进一步指出市场行为的规则相关。可见,制度演化和选择是典型的非线性、非稳态的机制。

交易成本说有几个隐藏的假设:第一,工业组织是无限可分的,组元之间的合作效应可以忽略。第二,二体交换的价格和社会背景无关。这两个假设对劳动分工导致规模(scale)、范围(scope)递增的企业都不成立(Chandler 1995)。第三,交易合同的签订忽略不可预测的不确定性带来的合同的非完全性。在现实社会里,道德永远是法律的补充,因为不确定性产生软合同的道德,稳态过程才保证硬合同的效用。

科斯虽然提出一个好的问题,在方法上却给出令人误导的结论。他们认为资本主义的产权制度最终应当是普遍有效的,无论历史和社会条件有何不同。交易成本说不能解释工业化过程中,政府作用的增加和中介服务机构的增加。美国近年总统竞选的一个热门题目是司法制改革,因为美国的律师之多官司之盛,严重影响了美国经济的国际竞争能力,集团利益在过度的私人产权下使公共利益受到严重损害。即使就企业界而言,美国相对西欧日本的交易成本,有明显上升的趋势。小政府社会成本的减少未必能补偿私人监督成本的增加。断言企业发展和社会制度演变的动力仅仅是降低摩擦成本缺乏深刻的理论基础。以个人理性为基础的交易成本说不足以解释以集合行为为基础的社会理性。

(5.5) 李嘉图(Richardo)-列昂惕夫(Leotieff)佯谬

微观经济学和宏观经济学的矛盾,在微观经济简单加总后得到的宏观行为和观察矛盾。在微观经济学中,有一个均匀齐次定理或欧拉定理的应用,例如供求函数是零阶齐次函数,利润和成本函数是一阶齐次函数等。如果没有这个均匀齐次假设,均衡解优化解的存在就无法在线性理论的框架内讨论。宏观经济学中,货币学派的货币中性理论的微观基础也就是这个均匀齐次假设。列昂惕夫曾用供求函数的零阶齐次定理来反对凯恩斯的宏观经济理论。他认为只要货币是中性的,持续的失业就不可能存在(Leotieff 1936)。按照物理学中以提出者的名字命名的习惯,我把这个问题称之为“李嘉图(Richardo)-列昂惕夫(Leotieff)佯谬”。问题是,均匀齐次定理根据的是理想实验,并无经验检验的依据。原因是均匀齐次定理否认经济结构的非均匀性,自然和宏观的观察矛盾。

微观基础与宏观观察之间的矛盾有一个著名的佯谬,叫股权回报之谜 (Mehra and Prescott 1985)。公司有两种金融资产,一种是借来的钱,另一种是股票。股权有一个回报率。人们为什么去买股票而不把钱存在银行里,因为平均来说股市回报率要高于银行里没有风险的利率。如果整体经济处在一般均衡,将投资行为和消费行为联系起来,可以算出每个人的均衡消费,也可以计算股票市场的平均回报率是多少,结果发现股票市场的回报率高得不可思议,比均衡理论估计的高了30多倍。要解释这么高的回报率,不引进非均匀的经济结构和经济行为是不可能的。..

(5.6)参照系的时间尺度:长期与短期均衡如何界定

经济学家一直认为短期均衡是没办法确定的,但长期均衡应当可以知道,假如经济波动有收敛趋势。实际上恰恰相反,技术革命的进展使长期经济预报几无可能。例如弗里德曼提出的所谓自然失业率,到底应该是多少,对美国而言,五、六十年代说是.. 4%,八十年代说是.. 7%,西欧长期在12%左右。其实开放经济不可能有长期均衡(long-run equilibrium),而只能有移动中的均衡(moving Equilibrium)。和均衡经济学的信念相反。经济预报和天气预报一样,可能做短中期预报,不可能做长期预报。

计量经济学在八十年代所谓的单位根革命(unit-root revolution),把线性理论推到边际稳定性的极端(Nelson and Plosser 1982)。一个离散时间的经济系统如果处于稳态,它的时间序列的特征根应该在单位圆之外,使外来冲击必然衰减;如果在单位圆之内经济振荡就要爆炸。我们观察到的经济系统总在那里振荡,又不衰减又不爆炸,怎么描写呢?计量经济学家认为特征根只能在单位圆的边界上。

单位根模型是结构不稳定的系统。系数稍微扰动一点,不是爆炸就是衰减,总之无法维持持续振荡。在数学上,单位根的存在等价于非线性趋势 (Bierens 1995)。最简单的例子是分段线性的趋势转折模型,例如石油价格冲击造成GNP增长趋势的扭转,会造成统计检验的单位根假象(Perron 1989)。

(5.7) 经济波动的起源:内生节律还是外来驱动

宏观问题最核心的就是经济波动的起源。哈耶克认为经济波动本身就是对均衡理论的最大挑战。但卢卡斯想改变问题的提法,把有节律的经济波动视为无规则的经济噪声,便可纳入均衡经济学的框架(Lucas 1981)。

卢卡斯的贡献在恢复对经济波动的定量理论研究。我们早就知道,经济波动中各个经济成分的幅度并不一样,消费行为过份光滑,投资行为过份动荡。真实经济波动学派(real business cycle school)对这二者的解释作了不少有趣的工作。但随机过程的稳态理论对解释市场崩溃这样的现象束手无策。需要引进非线性动力学的机制。

我们发现如用非线性趋势观察周期波动,会观察到频率相对稳定的经济波动。而频率移动的不同方式,给结构演化的诊断提供许多有用的信息。非线性振荡或称色混沌给持续经济波动提供了自然的内生机制的解释。

经济波动有如生物钟,只能是非线性振荡。不同经济成分,例如投资、消费、和股市运动,有各自不同的频率特征,经济周期的“个性”并不相同。

(5.8) 测不准关系和动力学复杂性

经济学家已经注意到金融市场内生的不稳定性。交易者看见股价涨是买还是卖?如果是理性交易者,在均衡情况下应该卖,假如市场能迅速回归均衡;但多数投机者会继续买进,因为投机者预言市价走向会继续看涨,当然涨势总有回落之日。非均衡市场中成功的投机者会把握时机先买后卖赚取差价。在市场风潮成形时,维持市场均衡有很大的风险。负责平衡市场的监督者假如资产有限,他反而变成带头投机的人(Shleifer and Summers 1990)。传统经济学用两阶段的马尔科夫过程描写股市风潮的涨落趋势,其弱点是不能描写拐点(时机)的不确定性。

信号处理的测不准关系规定时间和频率两者不可能同时分辨精确。投机也有很大风险,因为股市升降的转折点是不可精确预见的。经济波动中经常观察到的过度反应和时机不确定性密切相关,这和理性预期理论断言相反,社会心理的集合效应是经济周期波动的重要来源。

(5.9)不可积问题动摇计量经济学的基础

现在计量经济学广泛依赖参数回归方法,其前提是经济系统是可积系统。此外还必须是稳态系统,使系统解析解的系数须不随时间改变。我们已经知道,绝大多数的动力学系统是不可积系统,不存在解析解。如果这个系统根本不可积,那么猜测函数的解析形式,用观察数据作回归分析就失去意义。这就要求我们发展分析非线性、非稳态的新的数学工具(Chen 1993, 1997)。

【六.研究科学方法、避免前人弯路】

中国的启蒙运动家,在本世纪初,对引进西方学术思想,作了可歌可泣的贡献。可惜的是,他们在救亡的危机之中,呐喊有余,分析不足。只注重引进结论,不注重研究方法,在若干基本问题上,犯了用传统观念曲解科学思想的概念性错误。就现代经济学引进中国的历史而言,错误影响深远者大体有三:

(1) 严复介绍达尔文理论,不译达尔文原作,而译赫胥黎的伦理学小册子,不仅开中国把科学理论加以意识形态化的先河,而且将“演化论”误译为“进化论”;梁启超进一步将生物多样化的演化曲解为“优胜劣败”的单向进化,他们对达尔文理论片面宣传,造成的广泛误解至今存在;孙中山认为,中国灭种的危险,在于中国近代的人口增长率低于英美,毛泽东认为,迟迟认识人口控制的重要,都可以追溯到严复、梁启超的影响。中国知识分子长期忽略经济技术问题的基础建设,对文化传统的批判付出过高的代价,是和中国早期启蒙运动家对科学的急功近利态度有关的。

(2) 国内对马克思分配原则“各尽所能,各取所需”的翻译不仅是不确切的(伍铁平 1979),而且是违背经济学常识的。马克思的原意是客观的操作:“按照”能力,“按照”需要,进行分配。但我们译成“尽”其所能就成为主观愿望了,你工作再努力,也可能被人怀疑没有尽力。我们在大跃进时宣传说,将来到物资极大丰富时,就可以各取所需了。这在技术缓慢变革的农业时代说得通,在技术飞跃变革的工业时代却是说不通的。

假如说吃饱饭就满足,只要粮食足够,也许不难“各取所需”。但生存必须以外人的消费欲望却永无止境,十年前满足的自行车,现在就会想小汽车,以后还会要专用飞机。经济学的基本出发点就是资源有限,但技术创造无止境,所以人的欲望也是无限。这才需要经济学家“按照能力,按照需要,进行分配(马克思的原意) ”。分配的办法可以多种:抽签,按能力,按地位(年资,权力,财产,功绩), 按需要(如按病急程度分配医疗次序)等等。如果任人自取,无需分配,经济学也就不存在了。其误导之处不仅助长了共产风的错误,也使我们很长时期不注意可操作的制度建设,用思想教育代替经营管理和市场机制。在中国经济改革举世瞩目的今天,应该进一步提高理论总结的水准。

(3) 目前国内流行的对凯恩斯名作“The General Theory (of Employment, Interest, and Money)”的译名“通论”也是不当的。英文“General Theory ”的提法,是凯恩斯比照爱因斯坦“广义(general)”和“狭义(special)”相对论(relativity)的关系,来描写凯恩斯宏观经济学理论和古典经济学的关系的。即广义相对论把狭义相对论作为自己的特殊例子包括在内,狭义相对论又把牛顿力学作为自己的特殊例子包括在内。但译成“通论”就和“泛论”之意差不多,完全失掉了原作的中心思想。把定量描写现代市场经济运作的数理经济学和传统的政治经济学放在一起,纳入为统治阶级辩护的“庸俗经济学”范畴,也不利于我们发展可观察的经验经济科学的努力。

中国早期启蒙运动家的这些缺点并不奇怪,因为中国文化本身缺乏数理经验科学的传统。引进科学研究的方法需要几代人的时间。对今天年轻的经济学人而言,不要崇拜西方经济学家主流学派的结论,认真研究西方经济学各个流派的方法,注意现实经验对理论的挑战,是中国经济学家有可能在二十一世纪有所作为的起点。

你的回应

回应请先 登录 , 或 注册最新话题 ( 更多 )

- 90小伙厦门开青旅,欢迎来看海! (王掰掰)

- 高智商男人的弱智表现 (灌水大王)

- 弟弟要睡了 (初號機)

- 你好。这里是虚拟女友 (与我常在)

- 看个学术论文可以看得欢欣鼓舞——关于批判功利主义 (流萤集)

No comments:

Post a Comment